Руководство администратора KeyStack

Введение

Полное наименование системы — KeyStack.

Краткое наименование системы — Платформа.

Разработчик системы — ITKey.

Краткое описание возможностей

Платформа динамической инфраструктуры предназначена для предоставления сервисов IaaS.

Требования к квалификации персонала

Системные администраторы Платформы отвечают за комплексную настройку инфраструктуры Платформы, предоставляемой в качестве услуги конечным потребителям, за устранение неисправностей, сбор диагностической информации и эскалацию неисправностей производителю аппаратной или программной составляющей Платформы.

Системные администраторы выполняют следующие функциональные обязанности в рамках работы с Платформой:

настройка и диагностирование системы;

обслуживание системного и прикладного программного обеспечения системы;

администрирование базы данных;

резервное копирование и восстановление данных;

производство регламентных работ и анализ их результатов.

К системным администраторам предъявляются следующие требования:

Навыки системного администрирования Linux;

Прохождение обучения от компании ITKey по использованию компонентов, разработанных вендором: DRS, HA, Portal;

Навыки работы со службами Платформы, в том числе способность самостоятельно осуществлять:

мониторинг программными средствами, внешний осмотр аппаратной составляющей комплекса;

изменение настроек Платформы;

сбор диагностических данных и эскалацию сложных проблем по гарантийным обязательствам производителю.

Для обеспечения функционирования системы необходимо наличие как минимум одного системного администратора.

Перечень эксплуатационной документации

Документация Платформы включает в себя следующие документы:

Паспорт облака

План по резервному копированию и восстановлению компонентов Платформы

Инструкция администратора

Инструкция пользователя

Инструкция по резервному копированию и восстановлению всех компонентов

Назначение и условия применения

Виды деятельности, функции

В состав Платформы входят следующие подсистемы:

Подсистема вычислительных ресурсов — обеспечивает виртуализацию вычислительных ресурсов и управление ими;

Подсистема хранения данных — обеспечивает управление ресурсами хранения;

Подсистема передачи данных — обеспечивает реализацию и управление виртуальной сетевой инфраструктурой;

Подсистема мониторинга — обеспечивает сбор метрик с ресурсов Платформы, мониторинг Платформы и ее сервисов;

Подсистема Оркестрации — обеспечивает возможность автоматизированного управления ресурсами виртуальной инфраструктуры Платформы.

Программные и аппаратные требования к Платформе

Требования к инфраструктуре приведены в Инструкции по установке.

Подготовка к работе

Перечень программного обеспечения, включающий системное, базовое и прикладное ПО, приведен в Пояснительной записке.

Системный администратор использует в работе следующие интерфейсы Платформы, доступные по представленным далее ссылкам:

Портал самообслуживания;

интерфейс Horizon;

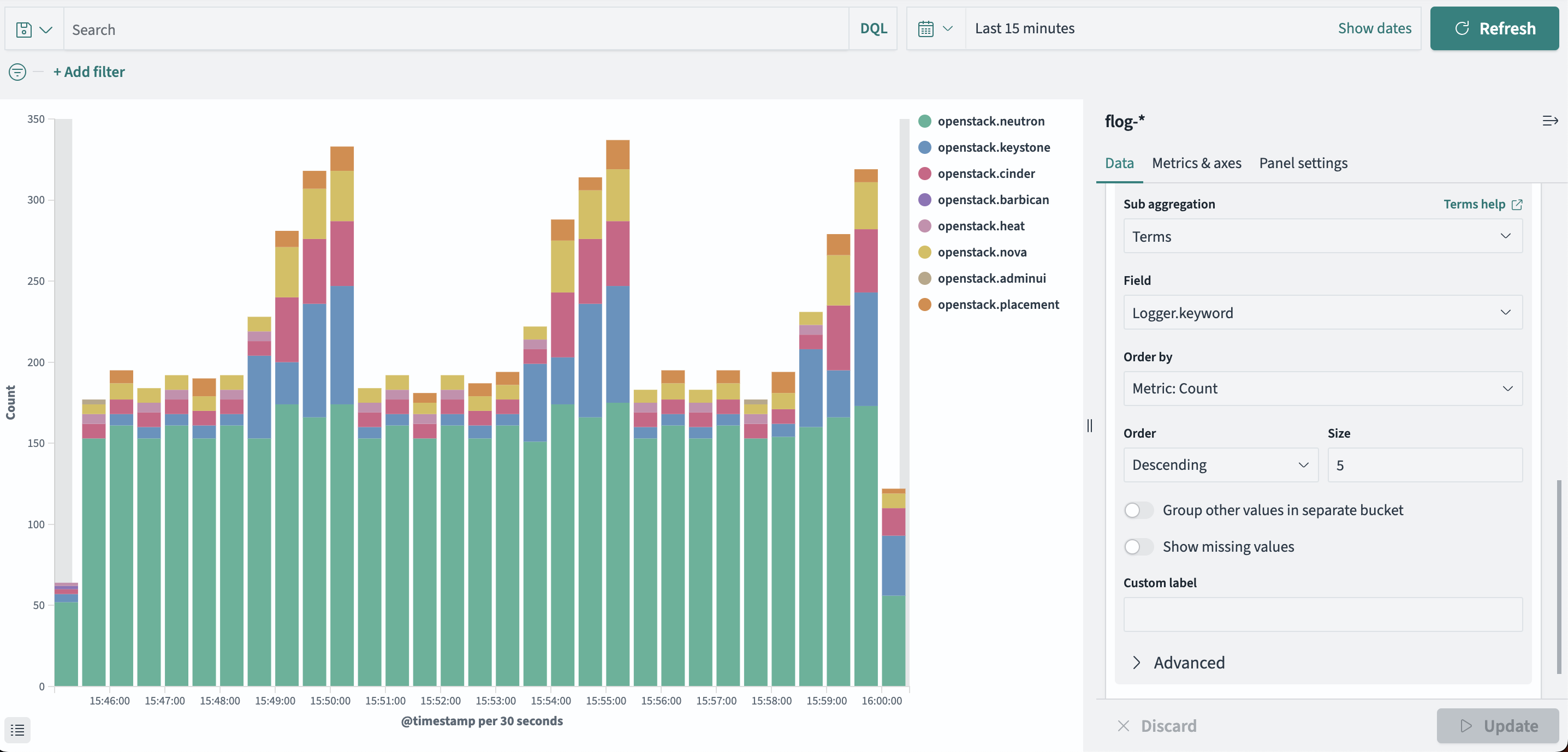

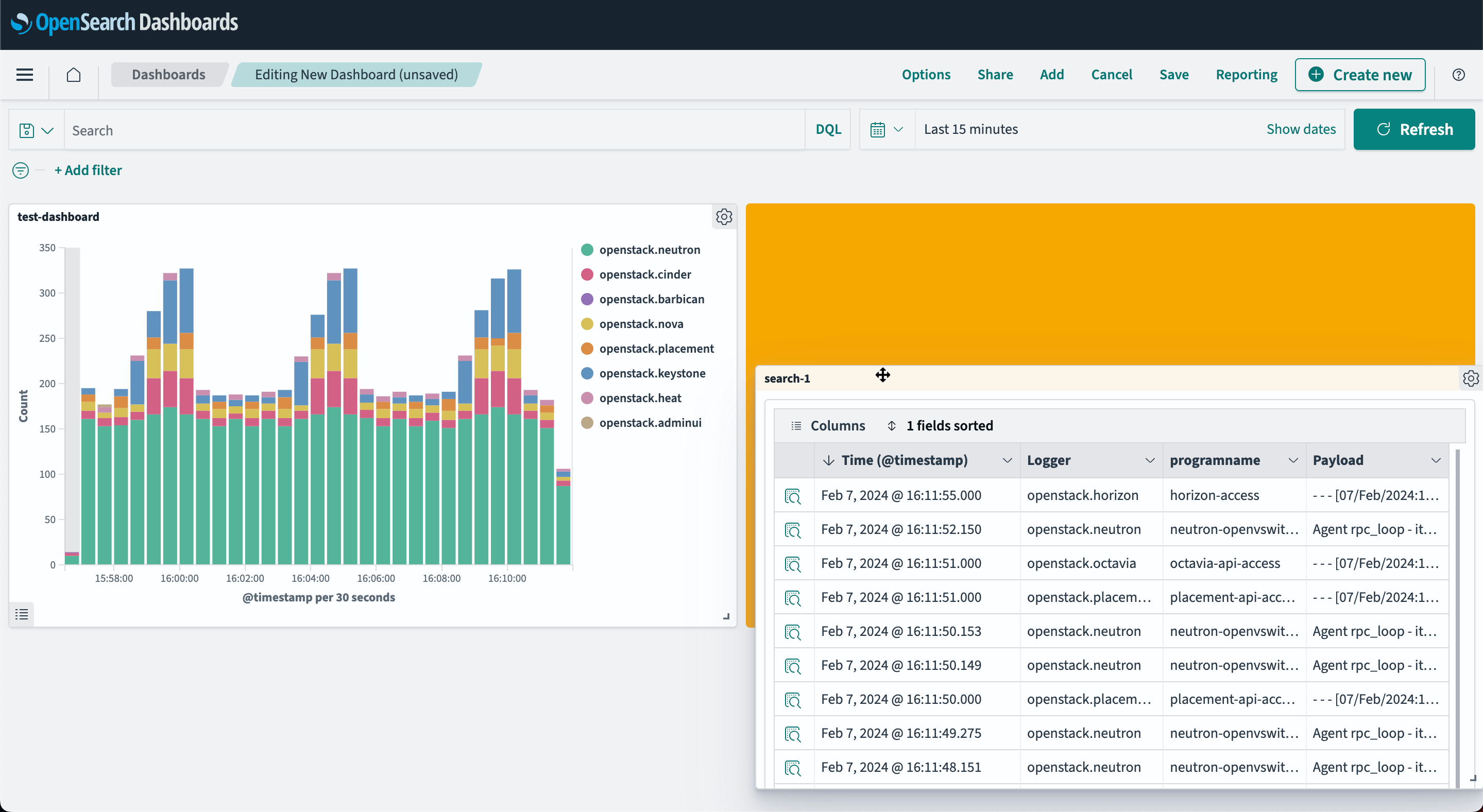

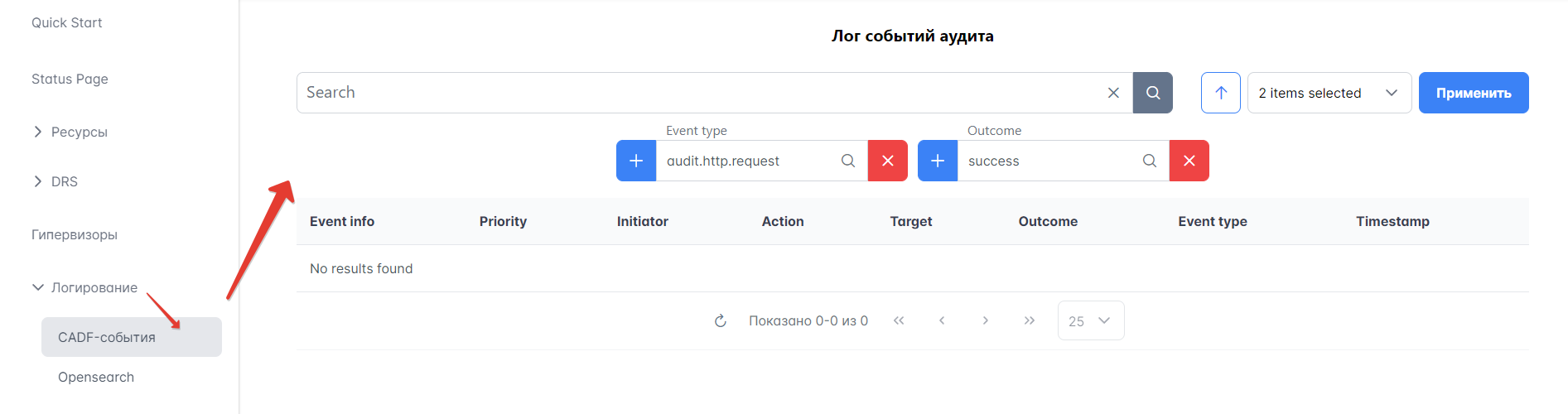

Opensearch;

Grafana;

Prometheus

API компонентов Платформы.

Основным рабочим веб-интерфейсом является Horizon.

Помимо веб-интерфейса, в работе используется Openstack CLI.

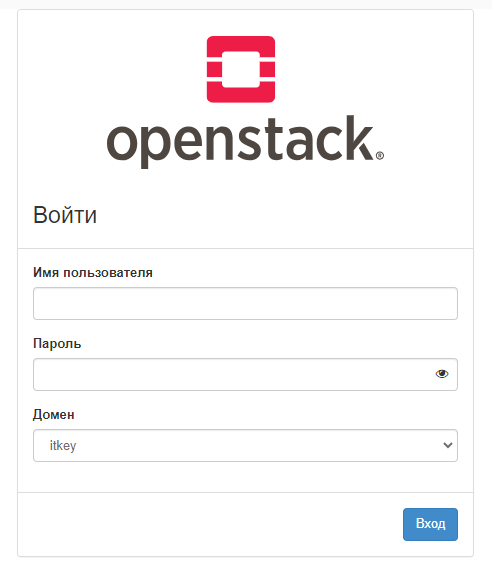

Подключение к Порталу самообслуживания

Подключение к Порталу самообслуживания производится с помощью веб-браузера. Для доступа к интерфейсам управления Портала самообслуживания могут использоваться браузеры актуальных версий:

Google Chrome 72 и выше;

Mozilla Firefox 63 и выше.

При запросе логина и пароля необходимо ввести учетные данные. Внешний вид формы аутентификации приведен на рисунке ниже.

Рисунок 1 — Окно аутентификации в Портале самообслуживания

Главная страница интерфейса управления имеет тематическое боковое меню (далее в тексте — левое меню), с помощью которого выполняется переход к различным разделам интерфейса управления Платформы.

Подключение к интерфейсу управления Openstack CLI

Перед началом работы в CLI необходимо получить исходный файл openrc и загрузить его на локальный компьютер администратора для установки переменных среды. Для получения файла openrc необходимо перейти в интерфейс портала администратора и скачать его на странице Status Page.

Important

Если используется библиотека Castellan, то при работе в Openstack CLI у администратора при каждом подключении будет запрашиваться пароль.

Openstack клиент можно установить на рабочее место администратора. Ниже приведен порядок установки Openstack клиента для различных ОС.

Установка Openstack клиента под Linux

Установка клиента Openstack:

sudo pip install python-openstackclient

Для проверки корректности настроек можно выполнить команду openstack server list, которая возвращает список ВМ.

Обновление клиента Openstack:

sudo pip install --upgrade python-openstackclient

Удаление клиента Openstack:

sudo pip uninstall python-openstackclient

Установка OpenStack CLI под Windows

Требуется установка последней версии Python с официального сайта http://python.org/downloads/windows. Дальнейшие инструкции выполняются в PowerShell.

Проверка работоспособности Python:

pip

Команда выводит справочную информацию о приложении. Если команда завершилась ошибкой, необходимо проверить правильность путей в переменной PATH.

Установка, обновление и удаление клиента Openstack выполняются аналогично разделу Установка Openstack клиента под Linux.

Запуск и выключение Платформы

Запуск Платформы

Почти все сервисы платформы — stateless, или имеют внутренние механизмы failover, прихода к консенсусу в кластере. Но есть сервис, на который надо обратить особое внимание — Galera Cluster. Поэтому в пункте Выключение всех компонентов Платформы важно было делать паузы перед выключением следующего узла и запомнить порядок выключения — это минимизирует до определенной степени шанс получить с “несобранным” кластером Galera Cluster с MariaDB после включения.

Порядок включения серверов Платформы в общем случае выглядит так:

Включите с паузами и по очереди управляющие узлы. Включайте в обратном порядке относительно выключения, т.е. если серверы были выключены в порядке controller1 → controller2 → controller3, то тогда, выдерживая достаточные паузы в 5-10 минут после загрузки Linux, производите включение в порядке controller3 → controller2 → controller1. При этом крайне желательно после загрузки сервера (в данном примере controller1) выполнить проверку статуса MariaDB.

Пример:

ssh controller1

mysql -uroot -pPassW0rd -s -s --execute="SHOW GLOBAL STATUS LIKE 'wsrep_local_state_comment';"

wsrep_local_state_comment Synced

Если в течение 5 минут статус не перейдет в Synced, все равно продолжайте с запуском остальных управляющих узлов. Когда узлы будут запущены, и позже будут запущены контейнеры consul-server, произойдет автоматический ребутстрап кластера MariaDB.

Включите вычислительные узлы.

Выполните проверку всех узлов с помощью инструкций, приведенных в разделе Порядок проверки сервисов при failover.

Оповестите владельцев workload’ов о возможности запуска их нагрузок в облаке — либо самостоятельно включите инстансы в зависимости от технического регламента.

Выключение всех компонентов Платформы

Для отключения платформы и её компонентов с сохранением данных необходимо выполнить следующие шаги:

Оповестить владельцев виртуальных машин о предстоящем отключении.

Выключить сервис DRS, деактивировав задание в панели администратора, затем последовательно подключившись к каждому контроллеру и введя команду

systemctl stop kolla-drs-container.service.Выключить сервис HA, последовательно подключившись к каждому контроллеру и введя команду

systemctl stop kolla-consul-container.service.Подключиться к серверу LCM для выполнения дальнейших действий.

Пример:

ssh lcm

source admin-openrc.sh

Зафиксировать состояние виртуальных машин на момент выключения региона, введя команду:

openstack server list --all-projects > VMs.$(date "+%Y-%m-%d-%H-%M-%S").txt

Выключить виртуальные машины средствами OpenStack, введя команду:

openstack server list --all-projects -c ID -f value | \

xargs -n1 openstack server stop

Проверить выключение всех виртуальных машин командой:

openstack server list --all-projects -c ID -c Status -f value | \

grep -v Active

Note

Если проверка покажет наличие виртуальных машин в статсуе ACTIVE, то необходимо повторить выключение каждой такой виртуальной машины индивидуально, введя команду openstack server stop <VM ID>, подставляя в качестве VM ID значенем из столбца ID предыдущего вывода.

Выключить узлы-гипервизоры средствами операционной системы:

for HOST in $(openstack hypervisor list -c "Hypervisor Hostname" -f value);\

do \

ssh -x ${HOST} "shutdown -h now";\

done

В строгом порядке очерёдности control3 → control2 → control1, с паузами достаточными для полного выключения сервера (время зависит от используемого аппаратного комплекса и должно быть уточнено в момент проведения ПСИ) средствами операционной системы выключить узлы слоя управления, проверяя процесс выключения и состояние серверов через IPMI:

ssh -x ctl3 ‘shutdown -h now’

# пауза до полного выключения

ssh -x ctl2 ‘shutdown -h now’

# пауза до полного выключения

ssh -x ctl1 ‘shutdown -h now’

# пауза до полного выключения

После выполнения этих шагов регион платформы будет полностью выключен.

Описание операций

В частной инсталляции Платформы не все опции команд Openstack CLI могут быть использованы, поэтому они приводятся для справки. Некоторые виды и типы интеграций могут быть недоступны и через API.

Управление квотами проекта

Квоты предоставляют возможность ограничивать использование ресурсов в проекте. Администратор может ограничивать ресурсы для каждого проекта по отдельности. В случае превышения квоты новый объект не сможет быть создан.

Управление квотами проекта осуществляется через CLI.

Пример запроса квот проекта по API (CLI)

С помощью команды openstack quota show --default можно увидеть список всех квот по умолчанию:

openstack quota show --default

+------------------------------+----------+

| Field | Value |

+------------------------------+----------+

| backup-gigabytes | 1000 |

| backups | 10 |

| cores | 100 |

| fixed-ips | -1 |

| floating-ips | 10 |

| gigabytes | 650 |

| gigabytes___DEFAULT__ | -1 |

| gigabytes_volumes-huawei | -1 |

| gigabytes_volumes-huawei-new | -1 |

| gigabytes_volumes-ssd | -1 |

| groups | 10 |

| health_monitors | None |

| injected-file-size | 10240 |

| injected-files | 5 |

| injected-path-size | 255 |

| instances | 50 |

| key-pairs | 10000 |

| l7_policies | None |

| listeners | None |

| load_balancers | None |

| name | None |

| networks | 100 |

| per-volume-gigabytes | -1 |

| pools | None |

| ports | 10000 |

| project | None |

| project_name | admin |

| properties | 128 |

| ram | 358400 |

| rbac_policies | 10000 |

| routers | 10 |

| secgroup-rules | 10000 |

| secgroups | 10000 |

| server-group-members | 100 |

| server-groups | 50 |

| snapshots | 10 |

| snapshots___DEFAULT__ | -1 |

| snapshots_volumes-huawei | -1 |

| snapshots_volumes-huawei-new | -1 |

| snapshots_volumes-ssd | -1 |

| subnet_pools | -1 |

| subnets | 100 |

| volumes | 50 |

| volumes___DEFAULT__ | -1 |

| volumes_volumes-huawei | -1 |

| volumes_volumes-huawei-new | -1 |

| volumes_volumes-ssd | -1 |

+------------------------------+----------+

Также можно увидеть все квоты для конкретного проекта. Для этого необходимо использовать ID проекта:

openstack quota show f538ffe832f34890ab5402995ff73102

+------------------------------+------------------+

| Field | Value |

+------------------------------+------------------+

| backup-gigabytes | 1000 |

| backups | 10 |

| cores | 100 |

| fixed-ips | -1 |

| floating-ips | 10 |

| gigabytes | 1000 |

| gigabytes___DEFAULT__ | -1 |

| gigabytes_volumes-huawei | -1 |

| gigabytes_volumes-huawei-new | -1 |

| gigabytes_volumes-ssd | -1 |

| groups | 10 |

| health_monitors | None |

| injected-file-size | 10240 |

| injected-files | 5 |

| injected-path-size | 255 |

| instances | 40 |

| key-pairs | 10000 |

| l7_policies | None |

| listeners | None |

| load_balancers | None |

| name | None |

| networks | 100 |

| per-volume-gigabytes | -1 |

| pools | None |

| ports | 500 |

| project_name | xcloud-devops |

| properties | 128 |

| ram | 200000 |

| rbac_policies | 10000 |

| routers | 100 |

| secgroup-rules | 1000 |

| secgroups | 1000 |

| server-group-members | 10 |

| server-groups | 10 |

| snapshots | 100 |

| snapshots___DEFAULT__ | -1 |

| snapshots_volumes-huawei | -1 |

| snapshots_volumes-huawei-new | -1 |

| snapshots_volumes-ssd | -1 |

| subnet_pools | -1 |

| subnets | 100 |

| volumes | 100 |

| volumes___DEFAULT__ | -1 |

| volumes_volumes-huawei | -1 |

| volumes_volumes-huawei-new | -1 |

| volumes_volumes-ssd | -1 |

+------------------------------+------------------+

Работа с флейворами ВМ

Просмотр списка флейворов ВМ

Просматривайте флейворы на Портале администратора либо в в Openstack CLI.

Просмотр списка флейворов в Openstack CLI выполняется командой:

openstack flavor list

Пример вывода команды:

+-----+-----------+-------+------+-----------+-------+-----------+

| ID | Name | RAM | Disk | Ephemeral | VCPUs | Is_Public |

+-----+-----------+-------+------+-----------+-------+-----------+

| 1 | m1.tiny | 512 | 1 | 0 | 1 | True |

+-----+-----------+-------+------+-----------+-------+-----------+

Для просмотра списка флейворов на Портале администратора перейдите в раздел Ресурсы → Flavors.

Создание флейвора ВМ

В Openstack CLI создание нового флейвора выполняется командой flavor create. Пример:

openstack flavor create --ram 512 --disk 1 --vcpus 1 <flavor-name>

где ram — размер оперативной памяти, disk — объем диска в GB, vcpus — количество vCPU, а <flavor-name> — наименование флейвора.

Полный перечень опций команды выглядит следующим образом:

openstack flavor create

[--id <id>]

[--ram <size-mb>]

[--disk <size-gb>]

[--ephemeral <size-gb>]

[--swap <size-mb>]

[--vcpus <vcpus>]

[--rxtx-factor <factor>]

[--public | --private]

[--property <key=value>]

[--project <project>]

[--description <description>]

[--project-domain <project-domain>]

<flavor-name>

где:

–id <id> — ID шаблона; ‘auto’ создает UUID (значение по умолчанию: auto);

–ram <MB> — размер памяти в MB (значение по умолчанию: 256MB);

–disk <GB> — размер диска в GB (значение по умолчанию: 0GB);

–ephemeral <GB> — размер эфемерного диска в GB (значение по умолчанию: 0GB);

–swap <MB> — дополнительный размер swap в MB (значение по умолчанию: 0MB);

–vcpus <vcpus> — количество vCPU (значение по умолчанию: 1);

–rxtx-factor <factor> — RX/TX фактор (значение по умолчанию: 1.0);

–public — шаблон доступен в других проектах (значение по умолчанию);

–private — шаблон недоступен в других проектах;

–property <key=value> — дополнительные свойства флейвора (опция может использоваться несколько раз для установки различных свойств);

–project <project> — разрешает доступ к флейвору из проекта <project> (по имени проекта или его ID), опция используется совместно с –private;

–description <description> — описание флейвора;

–project-domain <project-domain> — домен проекта (имя домена или его ID). Опция используется в случае конфликтов между названиями проектов;

–<flavor-name> — наименование флейвора.

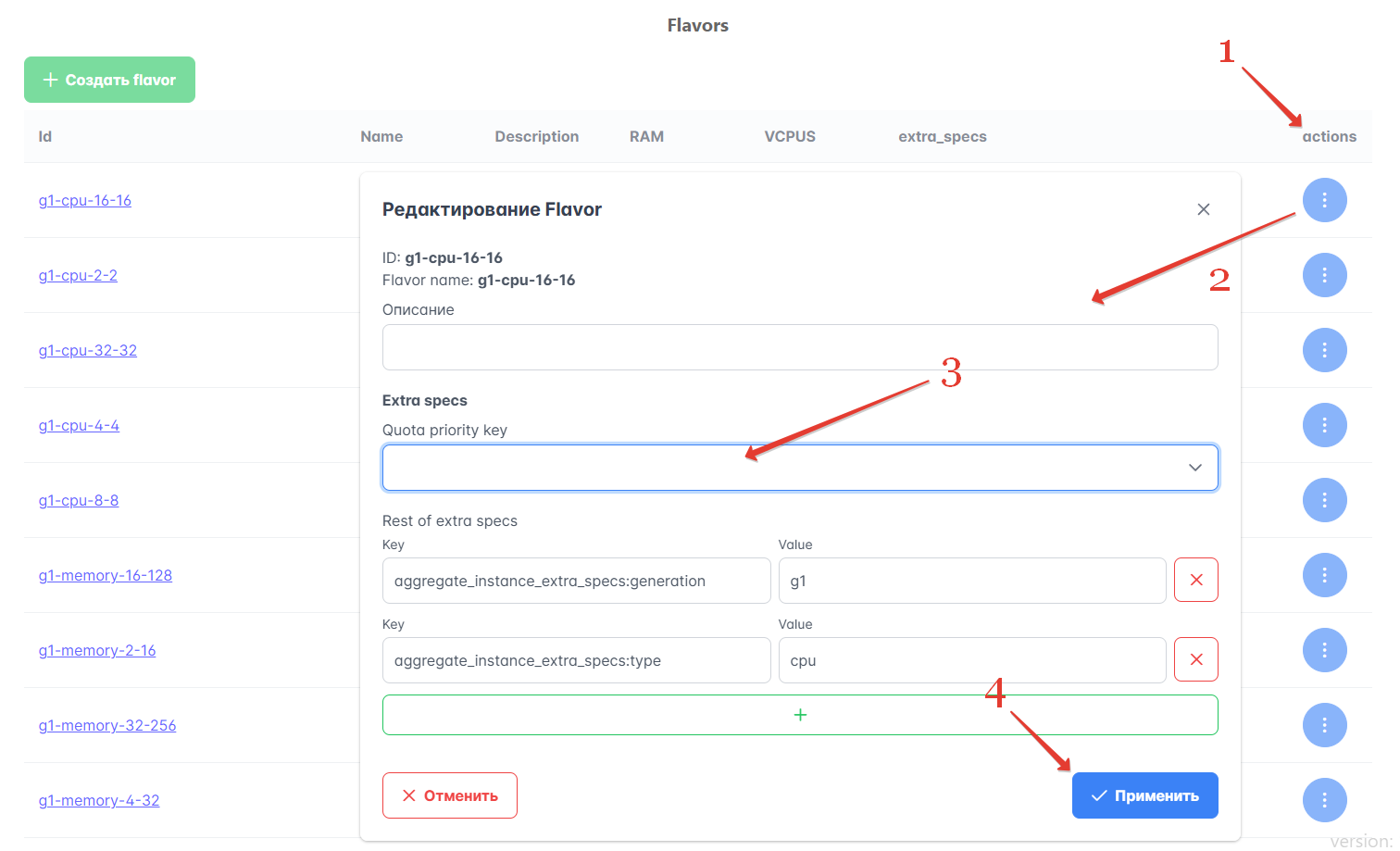

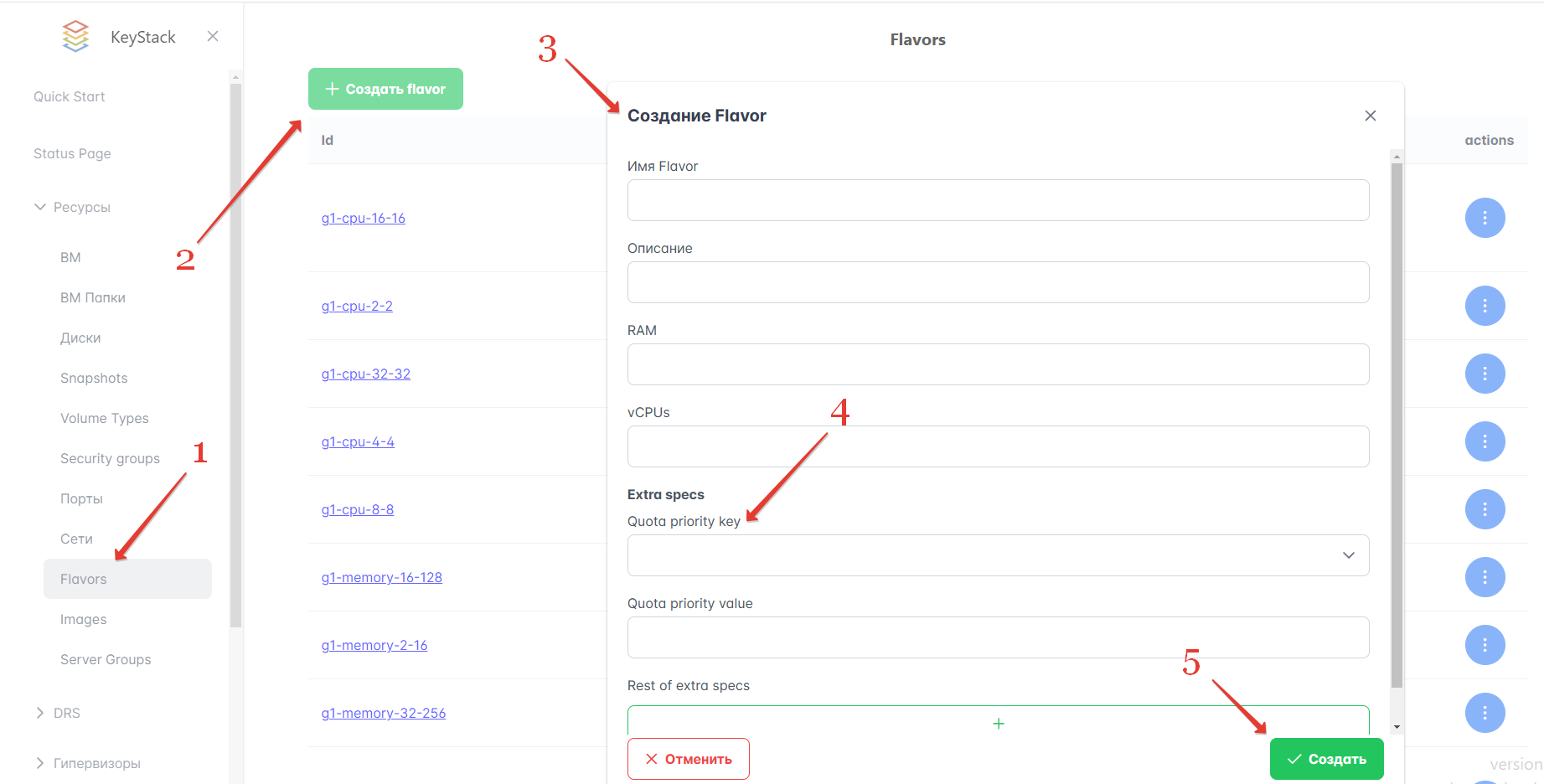

На Портале администратора:

В левом меню Портала перейдите в раздел Ресурсы → Flavors.

Нажмите кнопку “Создать flavor”.

Добавьте имя, описание, значения RAM и vCPUs для флейвора.

В разделе Extra specs укажите приоритеты для выделения ресурсов на ВМ, основанных на флейворе. Выберите

quota:cpu_sharesлибоquota:cpu_quotaв Quota priority key. Задайте значение для выбранного параметра в поле Quota priority value. Подробнее о приоритетах для ресурсов ВМ см. выше.

Рисунок 3 — Новый флейвор

Нажмите “Создать”.

Удаление флейвора ВМ

В Openstack CLI удаление флейвора ВМ выполняется командой:

openstack flavor delete <flavor> [<flavor> ...]

где <flavor> — наименование или ID флейвора. Одновременно может быть удалено несколько флейворов.

На Портале администратора для удаления флейвора выберите действия “Удалить” в столбце “Actions” для нужного флейвора.

Работа с шаблонами ВМ

Для упрощения и ускорения создания новых виртуальных машин используйте шаблоны ВМ на Портале администратора.

Создание шаблона

В левом меню Портала перейдите в раздел Ресурсы → ВМ.

Нажмите кнопку “Создать ВМ”.

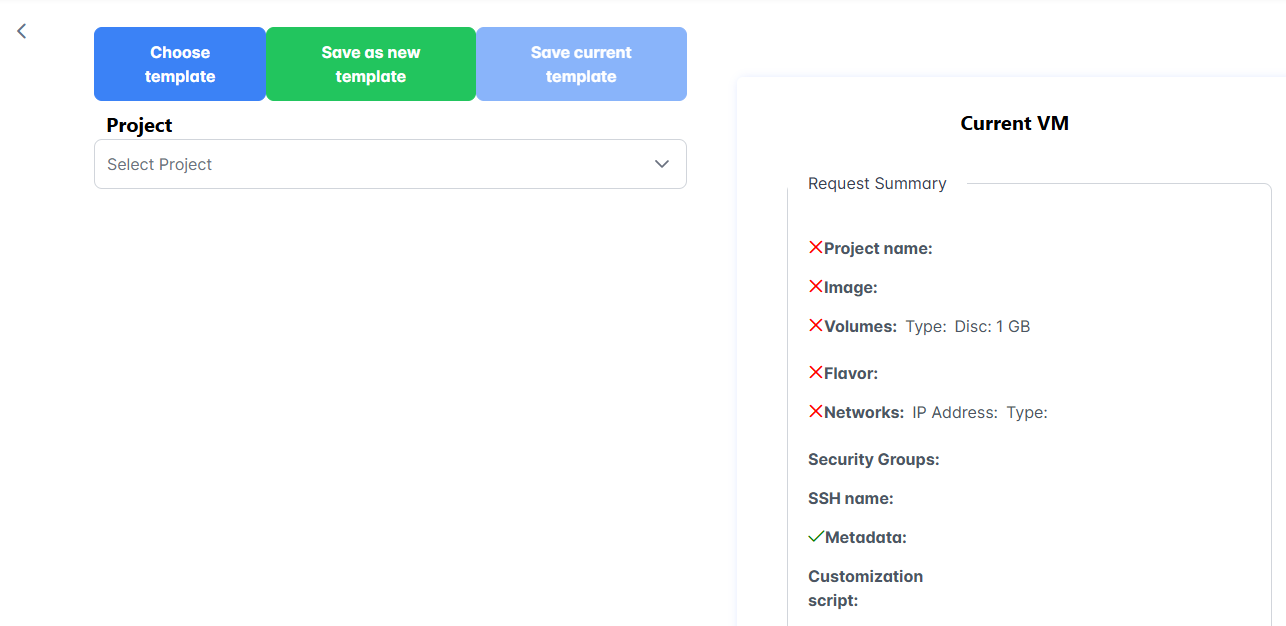

Если нет шаблона, выберите действие Save as new template в открывшемся окне.

Заполните поле Project. После выбора проекта будут доступны для заполнения остальные поля.

Рисунок 4 — Новый шаблон ВМ

Нажмите “Создать”.

Редактирование шаблона

В левом меню Портала перейдите в раздел Ресурсы → ВМ.

Нажмите кнопку “Создать ВМ”.

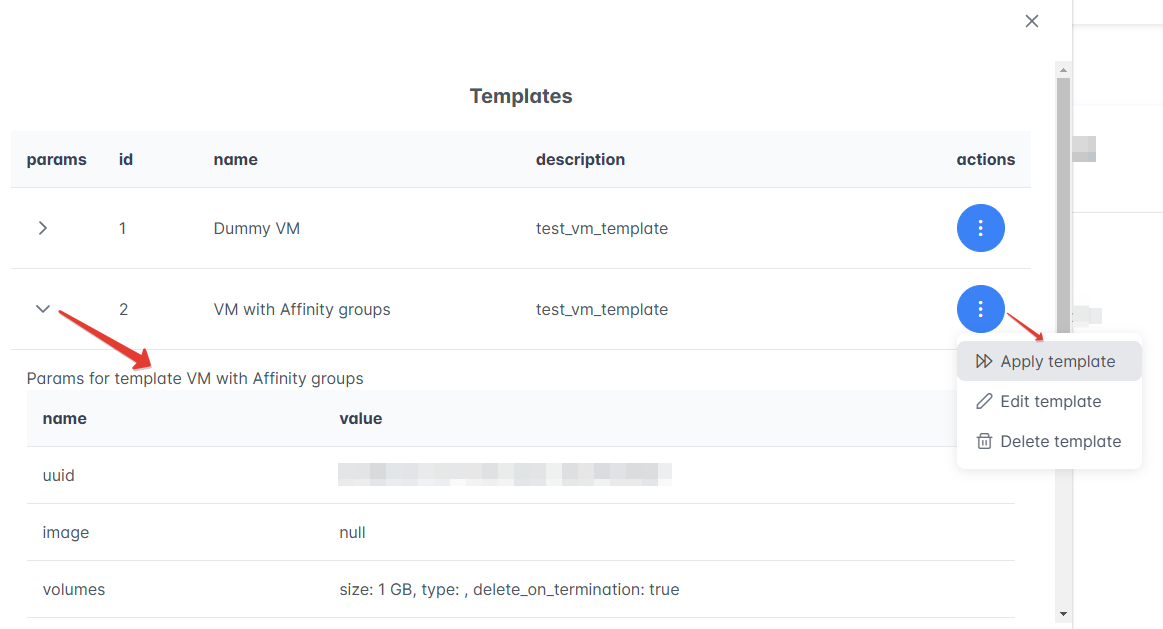

Выберите действие Choose template в открывшемся окне. Название выбранного шаблона отобразится на месте кнопки Choose template, а справа будут параметры создаваемой ВМ.

Найдите нужный шаблон в окне Templates. Нажмите значок

>в столбце “Params”, чтобы посмотреть параметры шаблона.Выберите дальнейшее действие с шаблоном в столбце “Actions”:

Для изменения параметров шаблона выберите Apply template.

Для изменения названия шаблона (Template name) или его описания (Template description) выберите Edit template. Нажмите “Редактировать”, чтобы применить изменения.

Для удаления шаблона выберите Delete template.

Рисунок 5 — Редактирование шаблона ВМ

Если вы выбрали действие Apply template, название выбранного шаблона отобразится на месте кнопки Choose template. Настройте параметры шаблона на вкладке Template params.

Выберите, как сохранить изменения параметров шаблона:

Чтобы применить изменения к отредактированному шаблону, нажмите Save current template.

Чтобы сохранить его как новый шаблон, нажмите Save as new template.

Создание ВМ из шаблона

В левом меню Портала перейдите в раздел Ресурсы → ВМ.

Нажмите кнопку “Создать ВМ”.

Выберите действие Choose template в открывшемся окне.

Найдите нужный шаблон в окне Templates и выберите для него Apply template в столбце “Actions”.

Название выбранного шаблона отобразится на месте кнопки Choose template, а справа будут параметры создаваемой ВМ. Настройте параметры создаваемой ВМ на вкладке New VM params.

Нажмите “Создать”.

Новая виртуальная машина со статусом BUILD появится в списке машин на странице ВМ.

Работа с образами ВМ

Просмотр списка образов

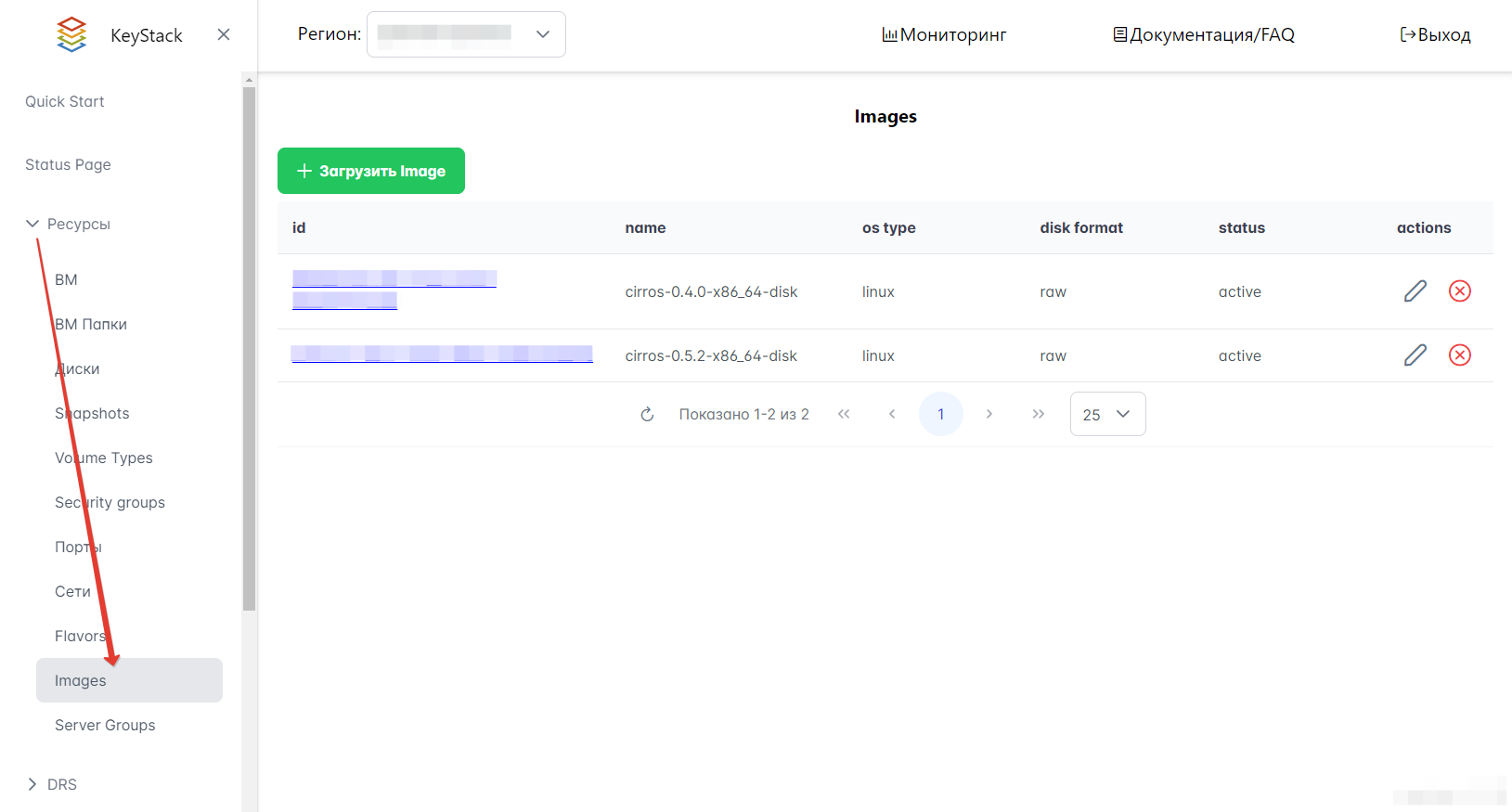

Просмотр образов осуществляется на Портале администратора, в интерфейсе Horizon или с использованием Openstack CLI.

Для просмотра списка образов на Портале необходимо в левом меню перейти в раздел Ресурсы → Images. Пример вида раздела представлен на рисунке ниже.

Рисунок 6 — Пример списка образов

Для просмотра списка образов в Openstack CLI выполните команду: openstack image list

Пример вывода команды:

+--------------------------------------+-----------------------------------+--------+

| ID | Name | Status |

+--------------------------------------+-----------------------------------+--------+

| 42f43e9d-7c53-46fa-ad87-846ef524d721 | CentOS-7-x86_64-GenericCloud-1905 | active |

Создание образа

Создание образа осуществляется в Портале самообслуживания, в интерфейсе Horizon или с использованием Openstack CLI. Образ можно создать путем загрузки файла в формате либо путем создания из существующего диска. Поддерживаются следующие форматы: raw, vhd, vhdx, vmdk, vdi, iso, ploop, qcow2, aki, ari и ami.

Создание образа из файла

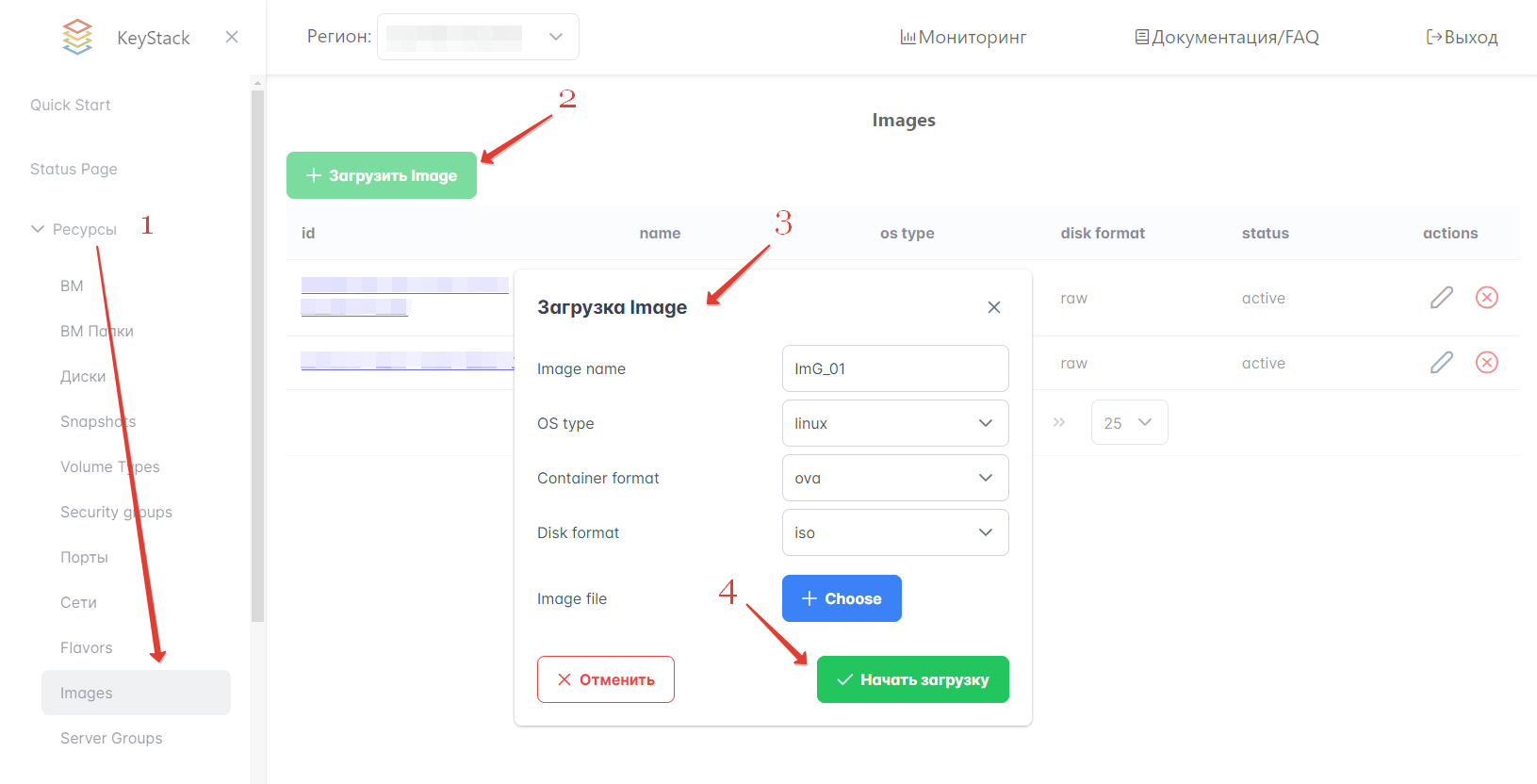

Для создания образа в Портале самообслуживания выполните следующие действия:

В левом меню Портала перейдите в раздел Ресурсы → Images.

Нажмите кнопку “Загрузить Image”.

Заполните поля. Обязательно нужно указать имя образа, тип ОС и выбрать файл для образа. Пример заполнения см. на рисунке ниже.

Нажмите кнопку “Начать загрузку”.

Рисунок 7 — Создание образа из файла

Для загрузки образа размером более 20GB рекомендуется использовать клиента командной строки.

Для загрузки образа в Openstack CLI выполните команду: openstack image create --private --container-format bare --disk-format qcow2 --file <имя_файла.raw> <имя_образа>

Если необходимо загрузить образ с поддержкой резервного копирования или смены пароля, добавьте свойства для работы с qemu-guest-agent: openstack image create --private --container-format bare --disk-format qcow2 --file <имя_файла.raw> --property hw_qemu_guest_agent=yes --property os_require_quiesce=yes <имя_образа>

Создание образа из существующего диска

Вы можете создать образ из существующего диска в интерфейсе Horizon. Для этого необходимо в левом меню перейти в раздел Диски, найти диск, из которого будет создаваться образ, и затем в выпадающем списке выбрать пункт меню “Загрузить образ”.

В форме создания образа нужно выбрать формат диска (см. рисунок ниже), указать название образа и нажать кнопку “Загрузить”.

Рисунок 8 — Создание образа из существующего диска

Загрузка образов в Glance

Вы можете загружать образы гостевых ВМ в Glance. Запрос на создание и загрузку образов в Glance передается в модуль states через Terraform в виде переменной user_images.

В файл tf_states/variables.tf добавьте переменную user_images следующего вида:

variable "user_images" {

description = "Pass user images as map"

type = map(any)

default = {

# Below is an example of user image definition

"ubuntu-24.04-x64" = {

image_source_url = "https://cloud-images.ubuntu.com/noble/current/noble-server-cloudimg-amd64.img"

container_format = "bare"

disk_format = "qcow2"

min_disk_gb = 5

visibility = "public"

properties = {

os_distro = "ubuntu"

os_type = "linux"

os_version = "24.04"

os_require_quiesce = "True"

ssh_key = "allow"

hw_machine_type = "q35"

}

}

}

}

После чего убедитесь, что эта переменная используется в модуле tf_states, вызываемом из файла tf_states/main.tf:

module "tf_states" {

...

user_images = var.user_images

}

Выгрузка образа

Выгрузка образа в файл выполняется в Openstack CLI следующей командой: openstack image save --file <file-name> <image-id>

где <file-name> — имя локального файла, а <image-id> — ID образа.

Удаление образа

Удалить образ ВМ можно на Портале администратора или в интерфейсе Horizon.

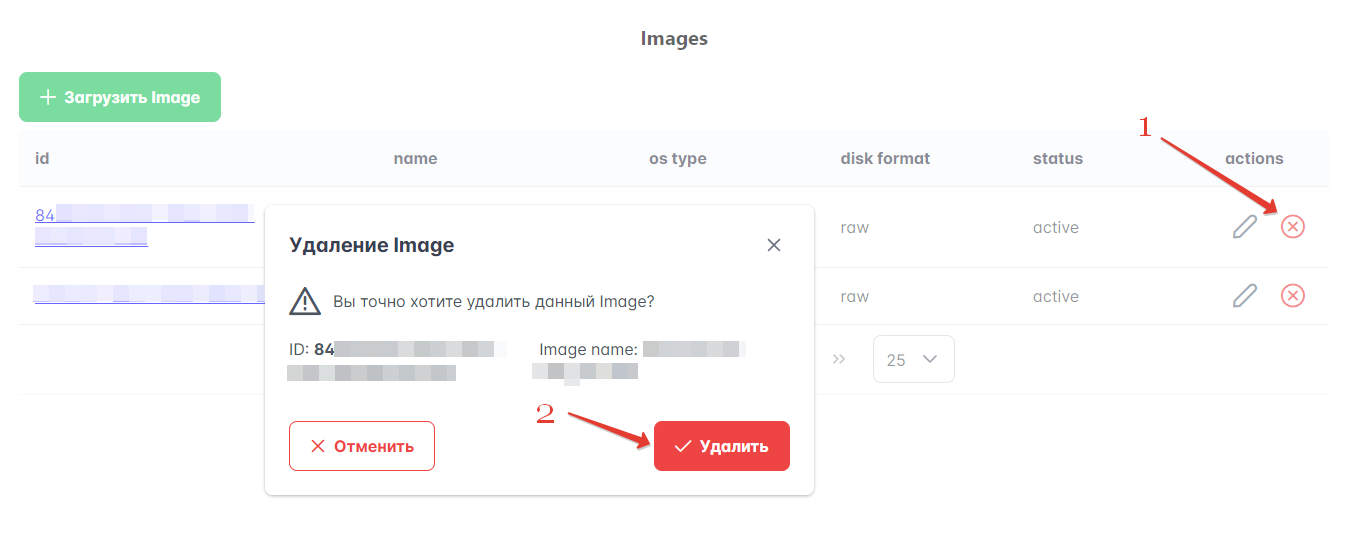

Для удаления образа в Портале администратора выполните следующие действия:

Перейдите в раздел Ресурсы → Images, выберите образ для удаления и нажмите значок

Xв столбце “Actions”.Проверьте имя и ID образа. Если все правильно, нажмите кнопку “Удалить” (см. рисунок ниже).

Рисунок 9 — Удаление образа

Включение множества очередей (multiqueue) в Unix-подобных операционных систем

KeyStack поддерживает множества очередей (multiqueue) у образа виртуальной машины (ВМ) и отдельной ВМ для операционных систем семейства Linux.

Ограничения

Функция множества очередей virtio-net обеспечивает повышение производительности, но имеет некоторые ограничения:

ОС ВМ ограничена ~ 200 векторами MSI. Для каждой очереди сетевого адаптера требуется вектор MSI, а также любое устройство virtio или назначенное устройство PCI. Определение экземпляра с несколькими сетевыми адаптерами virtio и виртуальными ЦП может привести к превышению лимита гостевого MSI.

Множества очередей хорошо работают для входящего трафика, но иногда могут вызвать снижение производительности для исходящего трафика.

Включение множества очередей увеличивает общую пропускную способность сети, но одновременно увеличивает потребление ресурсов CPU.

Если функция множества очередей была включена на хосте, но не была включена администратором в ОС ВМ, векторы MSI будут использоваться впустую.

Количество очередей автоматически устанавливается равным количеству виртуальных ЦП. Чем больше количество ЦП, тем выше пропускная способность сети.

Примечание. Для некоторых образов операционных систем, например, Centos6, недостаточно включить множества очередей только на уровне образа в конфигурации QEMU. Администратору ОС необходимо вручную включить функциональность с помощью ethtool на самой ВМ.

Включение множества очередей для новых ВМ из образа

Вариант включает множества очередей на уровне образа и будет работать для всех ВМ, созданных на базе этого образа после выполнения инструкции.

Создайте образ ВМ.

Получите список доступных образов, введя команду:

openstack image listСкопируйте ID нужного образа.

Включите множество очередей, введя команду:

openstack image set <IMG_ID> --property hw_vif_multiqueue_enabled=true

Проверка количества очередей

Создайте ВМ, в которой больше одного ЦП, и подключитесь к ее консоли.

Посмотрите все сетевые интерфейсы, введя команду:

ip link show

Ожидаемый вывод:

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo qlen 1000

link/ether fa:16:3e:e0:91:1e brd ff:ff:ff:ff:ff:ff

Здесь eth0 — сетевой интерфейс, для которого нужно проверить подключение множества очередей.

Посмотрите текущее количество очередей, введя команду:

ethtool -l <имя_сетевого_интерфейса>

Ожидаемый вывод:

Channel parameters for external:

Pre-set maximums:

RX: n/a

TX: n/a

Other: n/a

Combined: 1

Current hardware settings:

RX: n/a

TX: n/a

Other: n/a

Combined: 1

Установка нужного количества очередей для ВМ

Количество очередей не может быть больше количества виртуальных ЦП.

Выполните команду:

sudo ethtool -L <имя_сетевого_интерфейса> combined <число_очередей>

Пример ввода:

$ sudo ethtool -L eth0 combined 2

Проверьте новое количество очередей, введя команду:

ethtool -l <имя_сетевого_интерфейса>

Ожидаемый вывод:

Channel parameters for external:

Pre-set maximums:

RX: n/a

TX: n/a

Other: n/a

Combined: 1

Current hardware settings:

RX: n/a

TX: n/a

Other: n/a

Combined: 2

Работа с ВМ

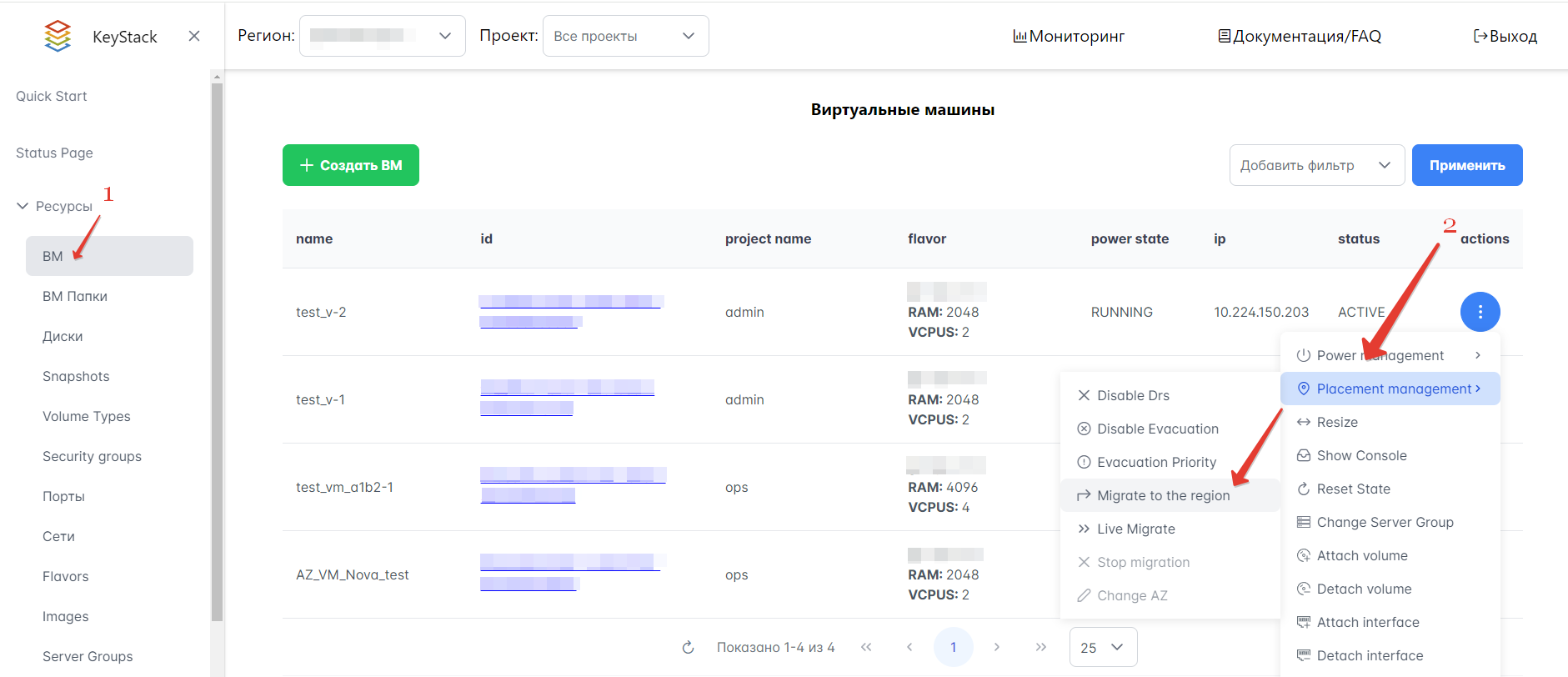

Просмотр списка ВМ

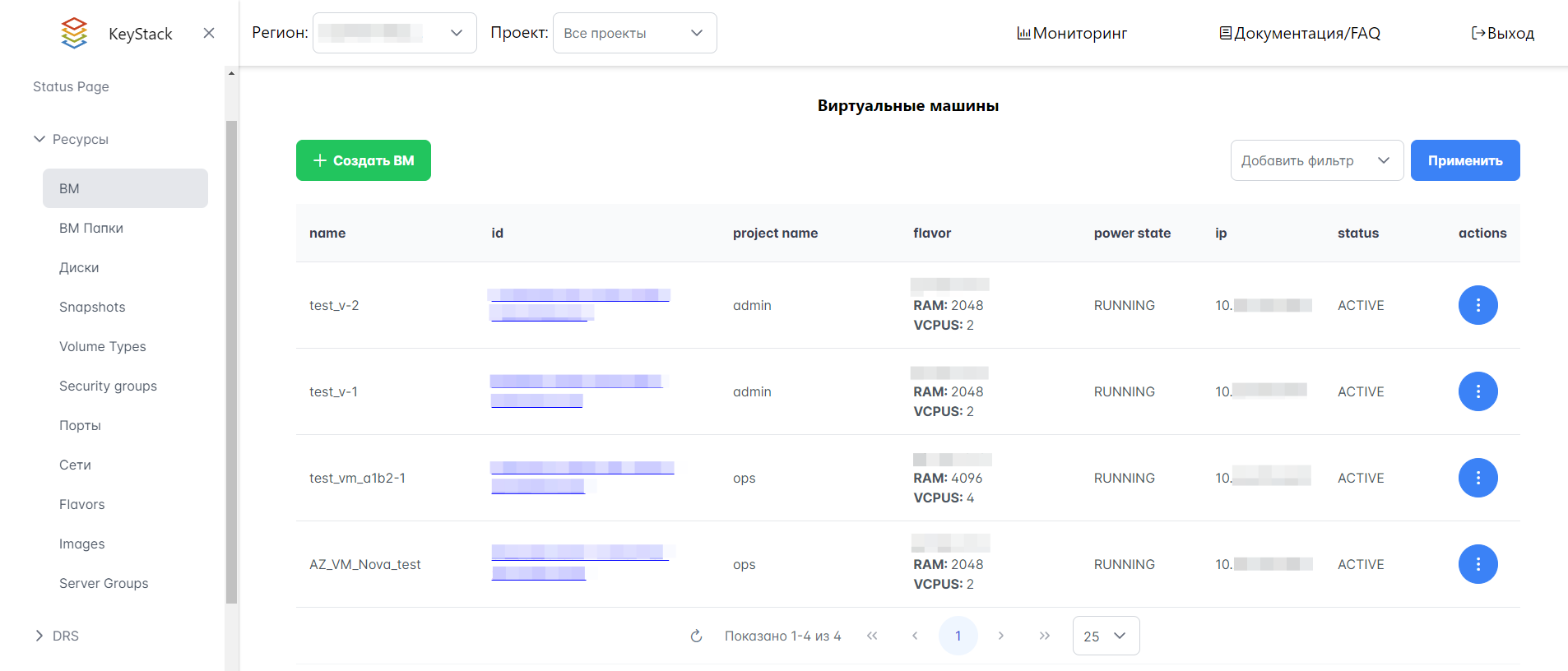

Просмотр списка ВМ проекта осуществляется в интерфейсе Портала администратора, Horizon или в Openstack CLI.

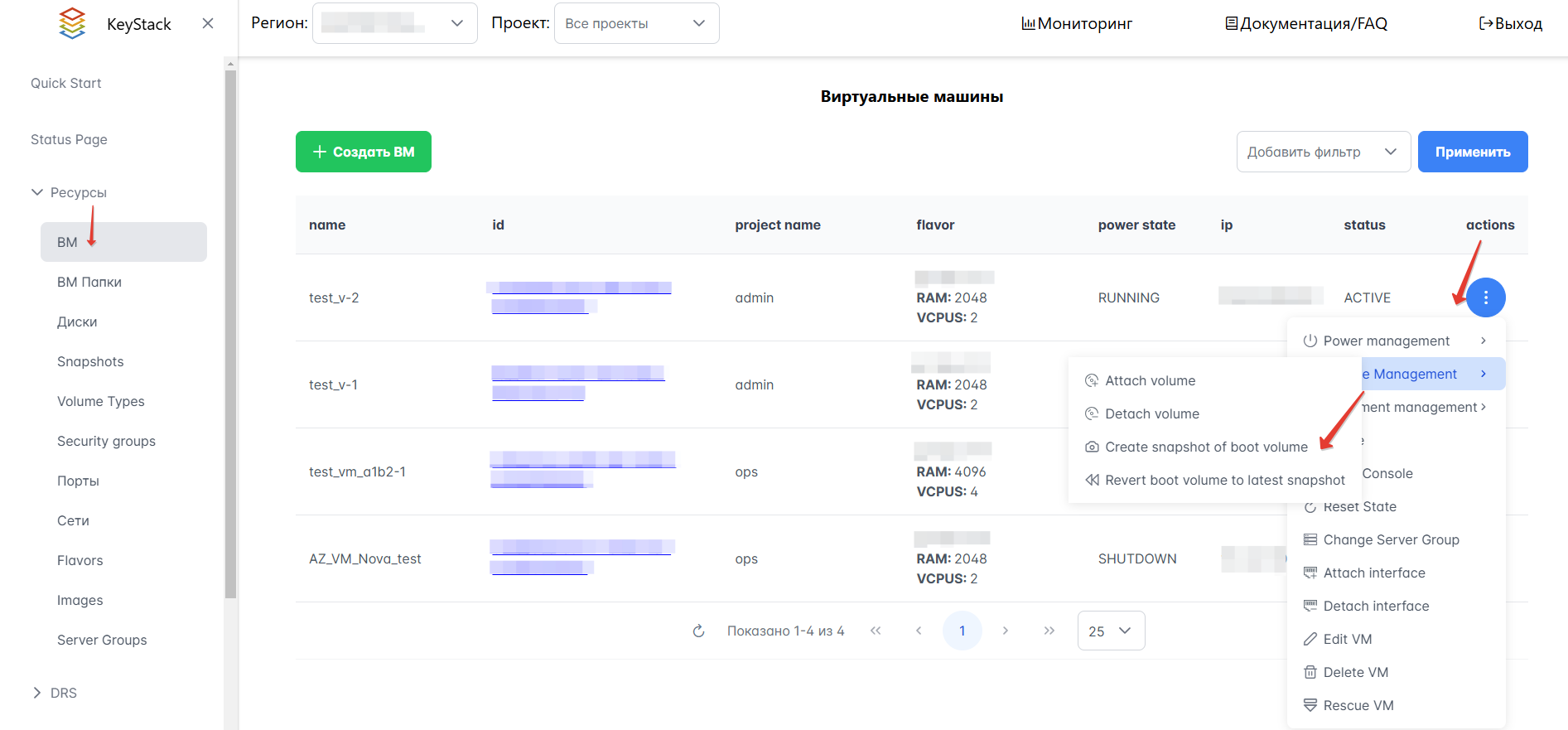

Для просмотра списка ВМ на Портале администратора необходимо выбрать Ресурсы → ВМ в левом меню интерфейса (см. рисунок ниже).

Рисунок 10 — Список ВМ на Портале администратора

Используйте фильтры в правом верхнем углу интерфейса для быстрого поиска нужных ВМ по определенным параметрам, таким как образ (image), MAC-адрес (MAC address), IP и LUN ID.

Просмотр списка ВМ в CLI выполняется командой server list. Полный перечень опций выглядит следующим образом:

openstack server list

[--sort-column SORT_COLUMN]

[--reservation-id <reservation-id>]

[--ip <ip-address-regex>]

[--name <name-regex>]

[--instance-name <server-name>]

[--status <status>]

[--flavor <flavor>]

[--image <image>]

[--host <hostname>]

[--all-projects]

[--project <project>]

[--project-domain <project-domain>]

[--user <user>]

[--user-domain <user-domain>]

[--long]

[-n | --name-lookup-one-by-one]

[--marker <server>]

[--limit <num-servers>]

[--deleted]

[--changes-before <changes-before>]

[--changes-since <changes-since>]

[--locked | --unlocked]

[--tags <tag>]

[--not-tags <tag>]

где:

–sort-column SORT_COLUMN — столбцы для сортировки данных (несуществующие столбцы игнорируются);

–reservation-id <reservation-id> — возвращать экземпляры ВМ, соответствующие резервированию;

–ip <ip-address-regex> — регулярное выражение для отбора ВМ по соответствующим адресам;

–name <name-regex> — регулярное выражение для отбора ВМ по имени;

–instance-name <server-name> — регулярное выражение для отбора ВМ по имени инстанса;

–status <status> — отбирать ВМ по указанному статусу;

–flavor <flavor> — отбирать ВМ по указанному шаблону ВМ (по наименованию или ID);

–image <image> — отбирать ВМ по указанному образу (по наименованию или ID);

–host <hostname> — отбирать ВМ по гипервизору размещения;

–all-projects — включать в выборку все проекты;

–project <project> — отбирать ВМ в указанном проекте (по наименованию или ID);

–project-domain <project-domain> — отбирать ВМ по домену проекта (по наименованию или ID). Опция используется в случае конфликтов между названиями проектов;

–user <user> — отбирать ВМ указанного пользователя (по имени или ID);

–user-domain <user-domain> — отбирать ВМ по домену пользователя (по имени или ID). Опция используется в случае конфликтов между именами пользователей;

–long — выводить дополнительные поля;

-n, –no-name-lookup — пропустить разрешение имен шаблонов ВМ и образов. Не используется совместно с опцией –name-lookup-one-by-one;

–name-lookup-one-by-one — при разрешении имен шаблонов ВМ и образов искать из по мере необходимости. Не используется совместно с опцией –no-name-lookup|-n;

–marker <server> — последняя ВМ предыдущей страницы. Выводит весь список ВМ после <server>, если не указано иное. Если используется с опцией –deleted, маркер <server> должен быть идентификатором (ID), иначе допускается использование наименование ВМ или ID;

–limit <num-servers> — максимальное количество ВМ в выводимом списке. Если указывается значение -1, тогда выводятся все ВМ. Если указанное значение <num-servers> превышает значение конфигурационного параметра osapi_max_limit, то выводится osapi_max_limit ВМ;

–deleted — выводить только удаленные ВМ;

–changes-before <changes-before> — выводить список ВМ, измененных до указанного момента времени. Указываемое время должно быть в формате ISO 8061 (например, 2016-03-05T06: 27: 59Z);

–changes-since <changes-since> — выводить список ВМ, измененных после указанного момента времени. Указываемое время должно быть в формате ISO 8061 (например, 2016-03-05T06: 27: 59Z);

–locked — выводить в список только заблокированные ВМ;

–unlocked — выводить в спискок только незаблокированные ВМ;

–tags <tag> — выводить ВМ с указанными тегами. Может использоваться несколько раз для отбора ВМ по нескольким тегам;

–not-tags <tag> — выводить только те ВМ, у которых нет указанного тега. Может использоваться несколько раз для указания нескольких тегов.

Запуск, перезапуск и остановка ВМ

Запуск, перезапуск и остановка ВМ осуществляется в интерфейсе Портала администратора, Horizon или в OpenStack CLI.

Для управления состоянием ВМ в интерфейса Horizon используйте кнопки “Выключить инстанс”, “Горячая перезагрузка инстанса” и “Холодная перезагрузка инстанса” (см. рисунок ниже).

Рисунок 11 — Кнопки управления состоянием ВМ

Текущий статус виртуальной машины отображается в столбце “Status” (см. рисунок выше).

В Openstack CLI операции запуска, перезапуска и остановки ВМ выполняются командами server start, server reboot и server stop соответственно. Синтаксис команд:

openstack server start <server> [<server> ...]

openstack server reboot [--hard | --soft] [--wait] <server>

openstack server stop <server> [<server> ...]

где:

<server> [ …] — ВМ или список ВМ (имя ВМ или ID);

–hard — “жесткая” перезагрузка;

–soft — “мягкая” перезагрузка;

–wait — дождаться завершения перезагрузки.

Создание ВМ

Создание ВМ осуществляется в интерфейсе Портала администратора, Horizon или в OpenStack CLI.

Для создания ВМ в Horizon необходимо выбрать Вычислительные ресурсы → Инстансы в левом меню интерфейса и нажать кнопку “Запустить инстанс”.

В форме “Создание нового инстанса” необходимо указать параметры создаваемой ВМ (см. рисунок ниже):

Instance — укажите имя ВМ;

Volume size — размер диска в GB;

Image — выберите образ из списка доступных;

Flavor — шаблон виртуальной машины, выберите из списка доступных

Key pairs — создайте новую ключевую пару или используйте существующую в проекте;

Network — укажите сеть, в которой будет доступна ВМ из списка сетей;

Security groups — укажите одну или несколько групп безопасности из списка доступных.

Рисунок 12 — Создание новой ВМ

Создание ВМ в Openstack CLI выполняется следующей командой:

openstack server create

(--image <image> | --image-property <key=value> | --volume <volume>)

[--password <password>]

--flavor <flavor>

[--security-group <security-group>]

[--key-name <key-name>]

[--property <key=value>]

[--file <dest-filename=source-filename>]

[--user-data <user-data>]

[--description <description>]

[--availability-zone <zone-name>]

[--host <host>]

[--hypervisor-hostname <hypervisor-hostname>]

[--boot-from-volume <volume-size>]

[--block-device-mapping <dev-name=mapping>]

[--nic <net-id=net-uuid,v4-fixed-ip=ip-addr,v6-fixed-ip=ip-addr,port-id=port-uuid,auto,none>]

[--network <network>]

[--port <port>]

[--hint <key=value>]

[--use-config-drive | --no-config-drive | --config-drive <config-drive-volume>|True]

[--min <count>]

[--max <count>]

[--wait]

[--tag <tag>]

<server-name>

где:

–image <image> — создать ВМ с использованием существующего образа (наименование или ID);

–image-property <key=value> — изменяемые свойства используемого образа;

–volume <volume> — создать ВМ с использованием указанного диска (наименование или ID). Данная опция автоматически создает отображение блочного устройства с индексом загрузки 0. Не следует использовать дублирующее сопоставление с использованием опции –block-device-mapping;

–password <password> — установить пароль для создаваемой ВМ;

–flavor <flavor> — использовать указанный шаблон (наименование или ID);

–security-group <security-group> — группа безопасности, назначаемая ВМ. Может использоваться несколько раз для назначения нескольких групп безопасности;

–key-name <key-name> — используемая ключевая пара (необязательный параметр);

–property <key=value> — установить дополнительные свойства ВМ (может указываться несколько раз для установки нескольких свойств);

–file <dest-filename=source-filename> — добавить в образ ВМ указанный файл (может указываться несколько раз для добавления разных файлов);

–user-data <user-data> — файл данных пользователя для обслуживания с сервера метаданных;

–description <description> — описание создаваемой ВМ;

–availability-zone <zone-name> — установить зону доступности ВМ;

–host <host> — создать ВМ с использованием службы Nova на конкретном гипервизоре;

–hypervisor-hostname <hypervisor-hostname> — создавать ВМ на указанном гипервизоре;

–boot-from-volume <volume-size> — при использовании в сочетании с параметром –image или –image-property этот параметр создает сопоставление блочного устройства с индексом загрузки 0 и сообщает службе compute создать том заданного размера (в GB) из указанного образа и использовать его в качестве корневого тома. Корневой том не будет удален при удалении ВМ. Этот параметр является взаимоисключающим с параметром –volume;

–block-device-mapping <dev-name=mapping> — создать блочное устройство. Блочное устройство указывается в формате <dev-name>=<id>:<type>:<size(GB)>:<delete-on-terminate>, где:

<dev-name> — наименование блочного устройства, например, vdb, xvdc (обазательный параметр);

<id> — наименование или ID тома, снапшота или образа (обязательный параметр);

<type> — volume (том), snapshot (снапшот) или image (образ). Значение по умолчанию — volume;

<size(GB)> — размер тома, если он создается из снапшота или образа (необязательный параметр);

<delete-on-terminate> — true или false, удалять при удалении ВМ. Значение по умолчанию — false (необязательный параметр);

–nic <net-id=net-uuid,v4-fixed-ip=ip-addr,port-id=port-uuid,auto,none> — создать сетевой адаптер. Опция используется несколько раз для создания нескольких адаптеров. Необходимо указывать ID сети или ID порта, но не оба сразу;

net-id — подключить сетевой адаптер к сети с UUID net-uuid;

port-id — подключить сетевой адаптер к порту с UUID port-uuid;

v4-fixed-ip — фиксированный IPv4-адрес сетевого адаптера (необязательный параметр);

none — сеть не подключена;

auto — автоматическое выделение сети.

–network <network> — создать сетевой адаптер и подключить к сети. Можно указывать несколько раз для создания нескольких сетевых адаптеров. Данная опция является оболочкой для опции –nic net-id=<network>, которая обеспечивает простой синтаксис для стандартного варианта подключения новой ВМ к сети. Для более сложных случаев рекомендуется использовать полный синтаксис –nic;

–port <port> — создать сетевой адаптер и подключить его к порту. Можно указывать несколько раз для создания нескольких сетевых адаптеров. Данная опция является оболочкой для опции –nic port-id=<port>, которая обеспечивает простой синтаксис для стандартного подключения новой ВМ к заданному порту. Для более сложных случаев рекомендуется использовать полный синтаксис –nic;

–hint <key=value> — подсказки для планировщика (необязательный параметр);

–use-config-drive — разрешает использование конфигурационного диска;

–no-config-drive — запрещает использование конфигурационного диска;

–config-drive <config-drive-volume>|True — устаревшая опция указания использования указанного тома в качестве диска конфигурации. Заменено на –use-config-drive;

–min <count> — минимальное количество ВМ для запуска. Значение по умолчанию — 1;

–max <count> — максимальное количество ВМ для запуска. Значение по умолчанию — 1;

–wait — дождаться окончания сборки;

–tag <tag> — теги ВМ. Можно указывать несколько раз для добавления нескольких тегов;

<server-name> — наименование ВМ.

Создание ВМ с поддержкой secure boot

Предварительные требования:

образ, из которого будет создаваться виртуальная машина, должен быть собран с поддержкой UEFI;

- в метаданные образа добавлены свойства os_secure_boot=required и hw_firmware_type=uefi.Добавить свойства можно через Horizon или CLI:

openstack image set --property hw_firmware_type=uefi --property os_secure_boot=required $IMAGE.

Администратор может запретить безопасную загрузку даже при наличии необходимых свойств в метаданных образа: openstack flavor set --property os:secure_boot=disabled $FLAVOR

Также есть возможность запрашивать безопасную загрузку, если хост ее поддерживает. Это делается через настройку метаданных образа: openstack image set --property os_secure_boot=optional $IMAGE

Узнать, поддерживает ли хост безопасную загрузку, можно таким образом:

COMPUTE_UUID=$(openstack resource provider list --name $HOST -f value -c uuid)

openstack resource provider trait list $COMPUTE_UUID | grep COMPUTE_SECURITY_UEFI_SECURE_BOOT

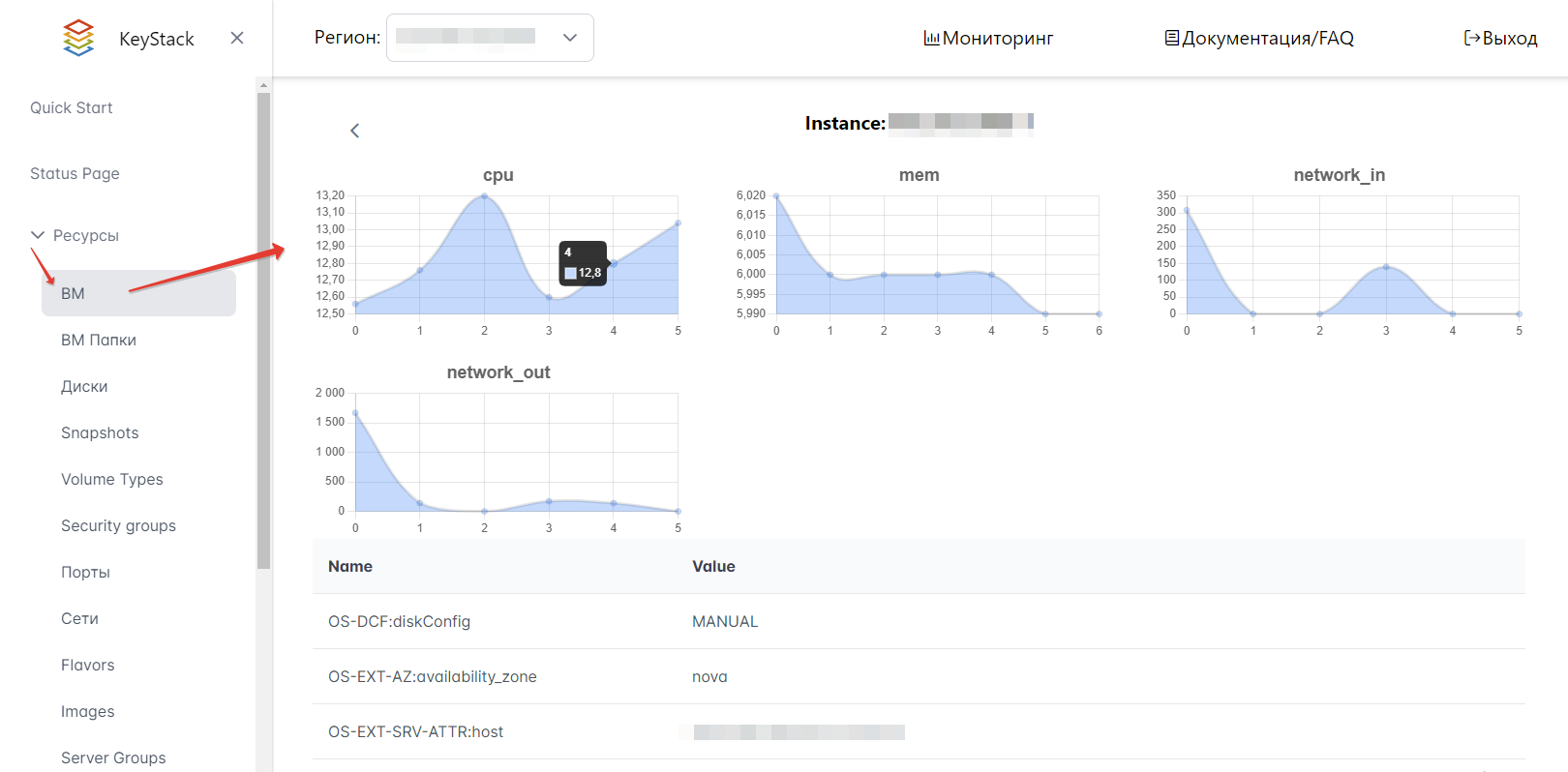

Мониторинг производительности ВМ

Вы можете просматривать потребление ресурсов виртуальных машин в интерфейсе Портала администратора. На странице каждой ВМ доступны графики со статистикой по таким показателям, как CPU (cpu), память (mem), входящий и исходящий трафик сети (network_in и network_out). Статистика обновляется каждые 10 минут.

Для просмотра производительности ВМ выберите Ресурсы → ВМ в левом меню Портала и нажмите ссылку с ID любой машины.

Для выбранной ВМ будут отображаться графики со статистикой по использованию CPU, памяти и сетевых ресурсов. Помимо графиков, информация о ВМ включает остальные детали, такие как ID и имя ВМ, статус, теги и т.д., которые отображаются внизу страницы.

Рисунок 13 — Статистика по ВМ

Мониторинг производительности вычислительных узлов

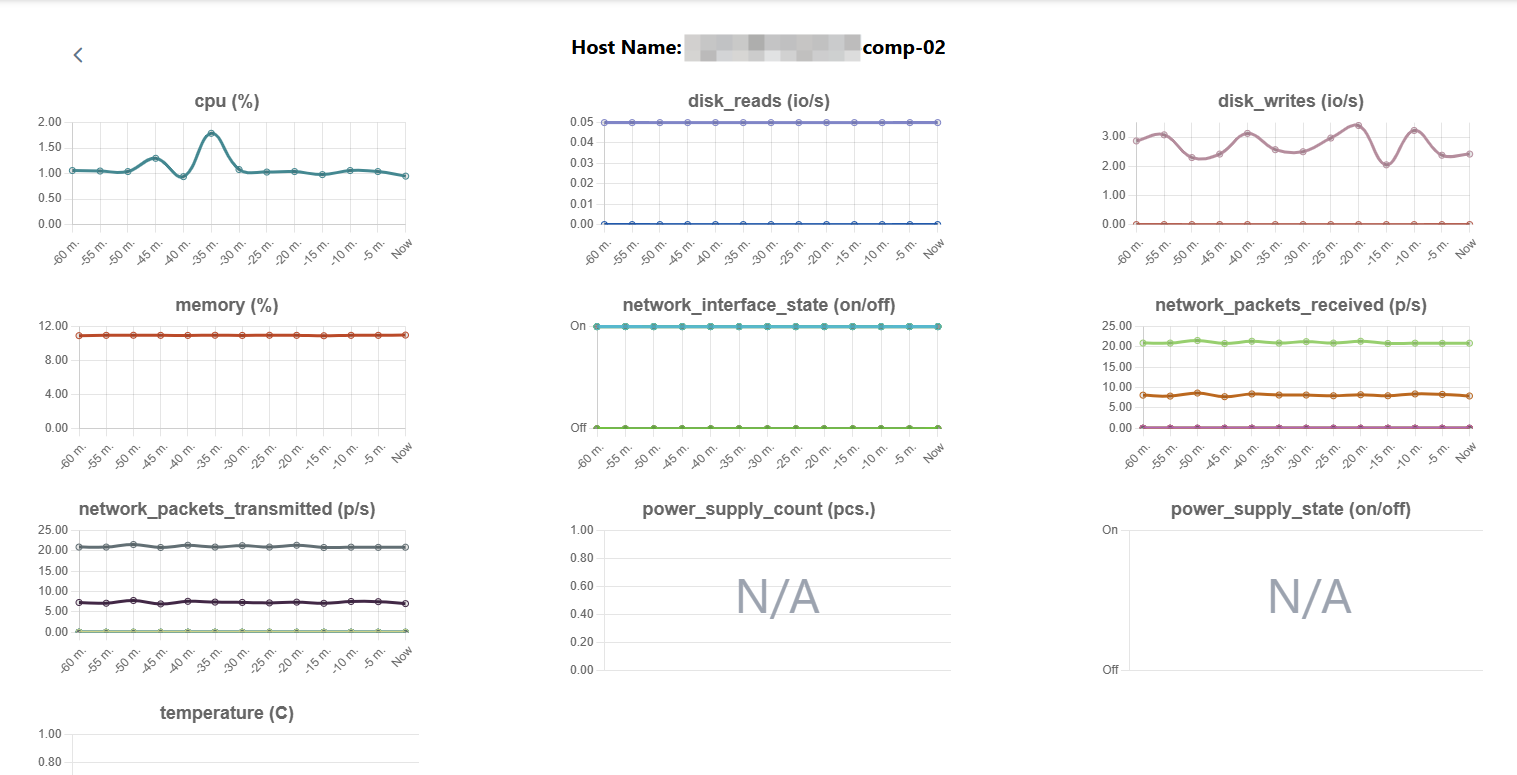

Вы можете просматривать информацию о потребляемых ресурсах вычислительных узлов (гипервизоров) в интерфейсе Портала администратора. На странице каждого гипервизора доступны графики со статистикой по таким показателям, как загрузка CPU, использование памяти и температура.

Для просмотра производительности вычислительного узла выберите Гипервизоры → Гипервизоры в левом меню Портала и нажмите ссылку с ID необходимого узла.

Рисунок 14 — Статистика по вычислительным узлам

Метрики вычислительных узлов отображают следующую информацию:

cpu— загрузка процессора в процентах;memory— загрузка памяти в процентах;network_interface_state— состояние сетевых интерфейсов, 1/0 (вкл/выкл);disk_reads— количество считываний с каждого диска , io/s (операций в секунду);disk_writes— количество записей на каждый диск, io/s (операций в секунду);network_packets_received— количество пакетов, полученных каждым сетевым интерфейсом, p/s (пакетов в секунду);network_packets_transmitted— количество пакетов, отправленных каждым сетевым интерфейсом, p/s (пакетов в секунду);power_supply_state— состояние блока(-ов) питания, 1/0 (вкл/выкл);power_supply_count— количество блоков питания по типам в единицах;temperature— температура по датчикам в градусах Цельсия.

После метрик вычислительных узлов идет таблица с деталями узлов, таких как ID, статус и состояние узла.

CPU Pinning

- Настройка гипервизора.Настройка предполагает добавление опций в загрузку ядра — isolcpus=2,3,4,5,6,7… - перечислите все ядра, которые нужно изолировать — добавление данной настройки предполагает перезагрузку сервера.

- Настройка сервиса nova-compute.Далее необходимо доработать конфигурацию сервиса nova-compute — добавьте в nova.conf гипервизора, на котором выполнена настройка isolcpus.

[compute]

cpu_dedicated_set=2-10 #указать желаемый набор ядер, который коррелирует с isolcpus

- Настройка host aggregate и flavor.Создайте агрегат, в который нужно добавить гипервизоры, где будет использоваться механизим CPU pinning. В метаданные агрегата добавьте параметр: pinned = true

Создайте флейвор нужного размера и добавьте в него метаданные:

aggregate_instance_extra_specs:pinned = true

hw:cpu_policy = dedicated

Использование механизма Memory ballooning

Memory ballooning — это технология управления оперативной памятью в виртуализированных средах, включая OpenStack. Она позволяет гипервизору динамически изменять объем оперативной памяти, доступной виртуальной машине, в зависимости от текущих потребностей.

Как работает memory ballooning:

В каждой ВМ устанавливается специальный драйвер (balloon driver), который взаимодействует с гипервизором. Гипервизор использует этот драйвер, чтобы запрашивать у ВМ “освободить” или “предоставить” память.

Когда гипервизору требуется освободить память, он посылает запрос balloon-драйверу в ВМ. Balloon-драйвер “заполняет” память ВМ с помощью выделения фиктивных блоков памяти, которые более не используются ВМ. Эти блоки памяти возвращаются гипервизору и могут быть перераспределены другим ВМ.

Когда ВМ требуется больше памяти, гипервизор может “сдуть” balloon, освобождая память, ранее выделенную другим ВМ.

Этот механизм включен в продукте по умолчанию, но для его работы необходимо выполнить требования к подготовке образов гостевых операционных систем.

Требование к образам Windows:

наличие Balloon драйвера, включен в VirtIO Windows Driver Pack,

установленая служба BalloonService (тип запуска службы - Auto).

Требования к образам Linux:

наличие VirtIO драйверов. Модуль virtio_balloon обычно включён в большинство современных дистрибутивов.

Изменение ресурсов ВМ

Изменение ресурсов виртуальной машины используется для увеличения или уменьшения количества виртуальных CPU или RAM виртуальной машины. Изменение ресурсов ВМ осуществляется в интерфейсе Портала администратора, Horizon или в OpenStack CLI.

Для изменения ресурсов ВМ в Horizon необходимо выбрать Вычислительные ресурсы → Инстансы в левом меню, далее найти ВМ, ресурсы которой необходимо изменить, и выбрать в контекстном меню “Изменить размер инстанса” (см. рисунок ниже).

Рисунок 15 — Меню изменения размера ВМ

В окне изменения размера нужно указать новый шаблон ВМ.

Изменение размера ВМ реализуется путем создания новой ВМ и копирования исходного диска ВМ в новый. Это двухэтапный процесс: первый шаг — изменение размера, второй шаг — либо подтверждение и успеха операции и освобождение старой ВМ, либо объявление возврата операции (освобождение новой ВМ и запуск старой ВМ).

В OpenStack CLI изменение размера ВМ выполняется командой server resize:

openstack server resize

[--flavor <flavor> | --confirm | --revert]

[--wait]

<server>

где:

–flavor <flavor> — новый шаблон ВМ;

–confirm — подтверждение завершения операции изменения размера ВМ;

–revert — восстановление состояния ВМ до изменения;

–wait — дождаться окончания операции;

<server> — изменяемая ВМ (имя или ID).

Работа с зонами доступности ВМ

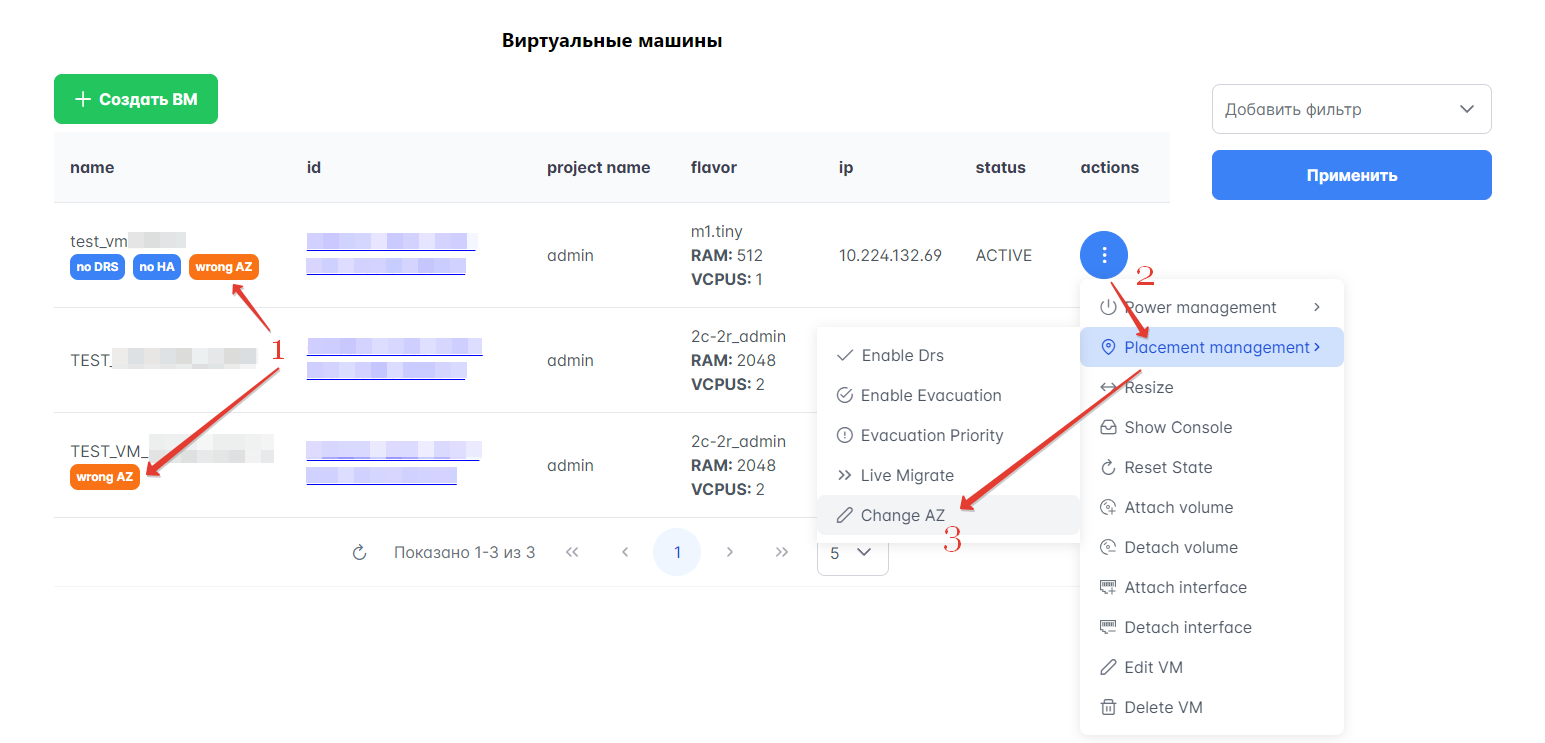

В KeyStack зоны доступности (Availability Zone, AZ) применяются для физической изоляции гипервизоров и обеспечения отказоустойчивости.

В результате ручной миграции зона доступности виртуальной машины может отличаться от зоны доступности гипервизора, где она находится. Подобные ВМ отмечаются лейблом “wrong AZ” в таблице ВМ на вкладке Ресурсы → ВМ.

Чтобы сменить зону доступности ВМ:

На вкладке Ресурсы → ВМ выберите любую из виртуальных машин, расположенных не в своей зоне доступности.

Нажмите выпадающий список в столбце “Actions” и выберите “Placement management”, а затем “Change AZ”.

Рисунок 16 – Смена зоны доступности ВМ

В открывшемся окне выберите зону доступности в выпадающем списке и нажмите “Применить”.

Рисунок 17 — Выбор зоны доступности ВМ

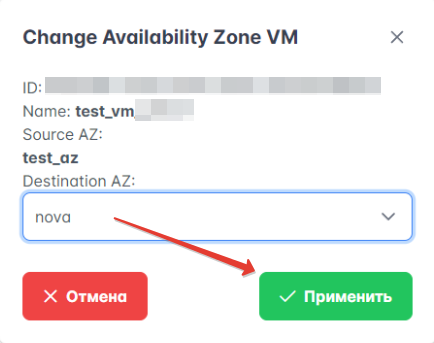

Работа с группами серверов ВМ

В KeyStack группы серверов ВМ (сервер-группы, server groups) применяются для объединения виртуальных машин в группы, которым можно присвоить определенные свойства. Группы серверов привязаны к конкретному проекту.

Для создания группы серверов ВМ в Портале администратора выполните следующие действия:

В левом меню Портала перейдите в раздел Ресурсы → Server Groups.

Нажмите кнопку “Создать Server Group”.

Заполните поля. Обязательно нужно указать имя группы и политику расположения. При выборе anti-affinity policy необходимо также указать максимально возможное количество ВМ на хост. Когда все поля будут заполнены, нажмите кнопку “Создать”.

Рисунок 18 — Группы серверов ВМ

Для просмотра всех данных о группе серверов нажмите ID группы на странице списка всех групп.

Для удаления группы серверов ВМ найдите в списке нужную группу, нажмите выпадающий список в столбце “Actions” и выберите пункт “Удалить”.

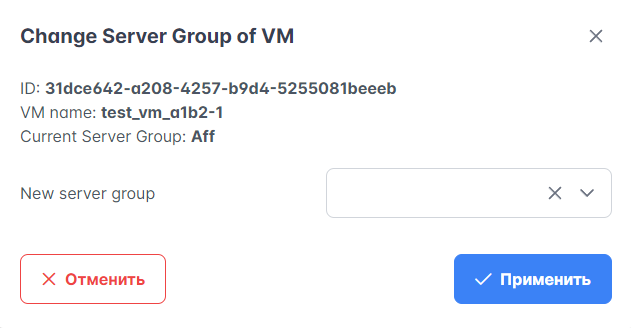

Для добавления ВМ в группу серверов или удаления из нее выполните следующие действия:

На вкладке Ресурсы → ВМ выберите виртуальную машину, которую нужно добавить в группу серверов или удалить из нее. Нажмите “Change Server Group” в столбце “Actions” для этой ВМ.

В открывшемся окне заполните поле “New server group”. Чтобы добавить ВМ в группу, выберите эту группу из выпадающего списка. Чтобы удалить ВМ из группы, нажмите значок

Xи оставьте поле пустым. Текущая группа ВМ отображается в поле “Current Server Group”.Нажмите кнопку “Применить”.

Рисунок 19 — Изменение группы серверов для ВМ

Удаление ВМ

Удаление ВМ осуществляется в интерфейсе Портала администратора, Horizon или в OpenStack CLI.

Для удаления ВМ в Horizon необходимо выбрать Вычислительные ресурсы → Инстансы в левом меню, далее найти ВМ, которую необходимо удалить, и выбрать в контекстном меню пункт “Удалить инстанс” (см. рисунок ниже).

Рисунок 20 — Удаление ВМ

Если необходимо удалить несколько виртуальных машин, то нужно выбрать их в списке и выбрать в контекстном меню пункт “Удалить” (см. рисунок ниже).

Рисунок 21 — Удаление группы ВМ

Удаление ВМ в CLI выполняется командой server delete. Синтаксис команды: openstack server delete [--wait] <server> [<server> ...]

где:

–wait — дождаться завершения удаления;

<server> [<server> …] — ВМ (список ВМ) для удаления (имя ВМ или ID).

Миграция ВМ

Миграция ВМ в CLI выполняется командой server migrate. Синтаксис команды:

openstack server migrate --os-compute-api-version 2.87

[--live-migration]

[--host <hostname>]

[--shared-migration | --block-migration]

[--disk-overcommit | --no-disk-overcommit]

[--wait]

<server>

где:

–live-migration — выполнить live-миграцию ВМ. Нужно использовать опцию –host для указания целевого вычислительного узла;

–host <hostname> — выполнить миграцию на вычислительный узел <hostname>;

–shared-migration — выполнить общую live-миграцию (миграция по умолчанию);

–block-migration — выполнить блочную live-миграцию;

–disk-overcommit — разрешить избыточную фиксацию диска на целевом управляющем узле;

–no-disk-overcommit — не выполнять избыточную фиксацию диска на целевом управляющем узле;

–wait — дождаться завершения миграции;

<server> — мигрируемая ВМ (имя или ID).

Миграция ВМ с перегрузкой по памяти

При работе с ВМ с перегруженной памятью компонент Nova по умолчанию использует следующую формулу: Тайм-аут = базовый_тайм-аут (800 сек) * объем оперативной памяти (ГБ). Таким образом, live-миграция нагруженных ВМ с большим объемом ОЗУ может занимать много времени.

Существует механизм принудительного завершения миграции по истечении тайм-аута, который может использовать два сценария реализации:

Посткопирование (post-copy) — производится перенос ВМ на целевой вычислительный узел и постепенное донесение содержимого оперативной памяти. Работа ВМ до полного переноса памяти проходит в режиме пониженной производительности.

Автоматическая сходимость (auto converge) — если миграция не может завершиться, то компонент начинает замедлять работу процессора ВМ до тех пор, пока процесс копирования памяти не станет быстрее, чем изменение памяти ВМ.

Таким образом, можно оптимизировать процесс live-миграции, подобрав оптимальное время тайм-аута и выбрав предпочтительный сценарий реализации принудительного завершения миграции.

Note

Сценарий механизма администратор может выбрать при инсталляции на свое усмотрение. Для этого в репозитории региона необходимо создать файл config/nova/nova-compute.conf с содержимым:

[libvirt]

live_migration_completion_timeout = 800

live_migration_permit_post_copy = False

live_migration_permit_auto_converge = False

Администратор задаёт таймаут в секундах в формате целого числа и устанавливает значение True для выбранного сценария.

Также существует возможность принудительной отмены миграции. Когда большая ВМ достаточно долго находится в статусе миграции при live-миграции, становится доступно новое действие — отмена миграции. Это действие можно выполнить с помощью кнопки “Stop migration” в интерфейсе ВМ.

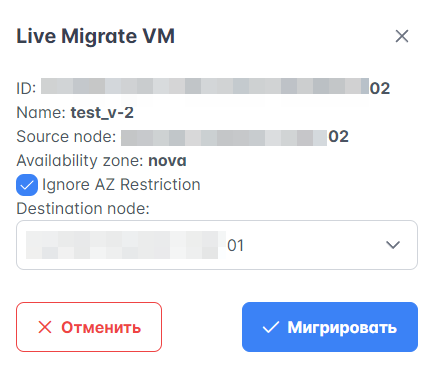

Live-миграция ВМ

Если у ВМ выставлено свойство availability_zone, при live-миграции этой ВМ не предлагаются хосты (гипервизоры) из других зон доступности. Это можно изменить, выбрав опцию “Ignore AZ restriciton” в интерфейсе ВМ, после чего для миграции станут доступны все хосты, а live-миграция будет проводиться с ключом force.

Чтобы провести live-миграцию ВМ с Портала администратора:

В левом меню Портала перейдите в раздел Ресурсы → ВМ и выберите любую машину из таблицы ВМ.

Нажмите выпадающий список в столбце “Actions” и выберите “Placement management”, а затем “Live Migrate”.

В открывшемся окне поставьте флажок “Ignore AZ restriciton”, выберите нужный гипервизор и нажмите кнопку “Мигрировать”.

Рисунок 22 — Live-миграция ВМ

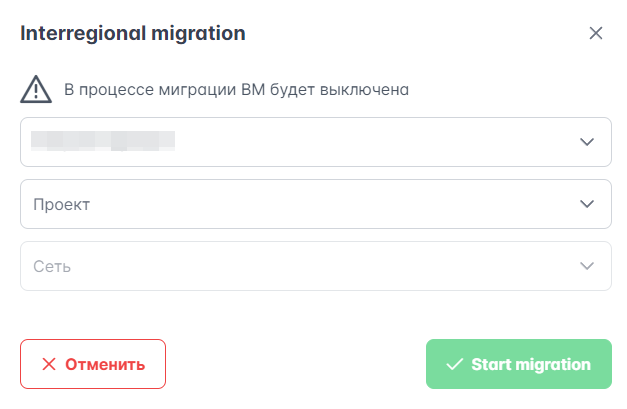

Миграция ВМ с дисками между регионами

При необходимости вы можете переносить виртуальные машины с дисками из одного региона в другой.

Чтобы перенести ВМ с дисками в другой регион:

На вкладке Ресурсы → ВМ выберите виртуальную машину с дисками для переноса.

Нажмите выпадающий список в столбце “Actions” и выберите “Placement management”, а затем “Migrate to the region”.

Рисунок 23 – Перенос ВМ с дисками в другой регион

В открывшемся окне по очереди выберите регион, проект и сеть для переноса ВМ. Нажмите “Start migration”.

Рисунок 24 – Выбор параметров для переноса ВМ в другой регион

Дождитесь завершения процесса переноса. Обратите внимание, что в процессе миграции ВМ будет выключена, а ее диски выгружены.

ВМ будет перенесена в другой регион и там запущена. После переноса ВМ будет сразу работать. Исходная ВМ не будет удалена.

Эвакуация ВМ с вычислительного узла

В контейнере kolla_toolbox на управляющем узле необходимо выполнить команду для эвакуации ВМ на другие вычислительные узлы в составе кластера:

nova host-evacuate-live <хостнейм_удалаяемого_узла>

Аварийное восстановление ВМ (Nova rescue)

Вы можете проводить аварийное восстановление ВМ на Портале администратора. Такие ВМ будут загружены с указанного вами загрузочного образа (обычно с той же ОС, на которой ВМ работает), и к ней будут подключены все ее диски. Статус ВМ изменится на RESCUE.

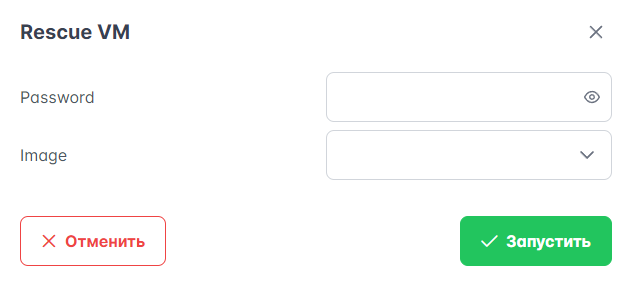

На вкладке Ресурсы → ВМ выберите виртуальную машину, которую нужно перевести в статус RESCUE. Нажмите “Rescue VM” в столбце “Actions” для этой ВМ.

Заполните поля — пароль и образ. Выбранный образ должен иметь следующие свойства: ‘hw_rescue_device’: ‘disk’ и ‘hw_rescue_bus’: ‘scsi’.

Нажмите кнопку “Запустить”. ВМ перейдет в статус RESCUE, а инстанс будет перезагружен из выбранного образа.

Рисунок 25 — Аварийное восстановление ВМ

Чтобы перевести ВМ обратно в статус ACTIVE, выберите действие “Unrescue VM” в столбце “Actions” для этой ВМ.

Работа с моментальными снимками ВМ

На Портале администратора вы можете создавать моментальные снимки ВМ, чтобы сохранить параметры виртуальных машин и в случае сбоя восстановить машины из этих снимков. В данный момент технология создания таких снимков ВМ поддерживается только для драйверов Huawei Dorado.

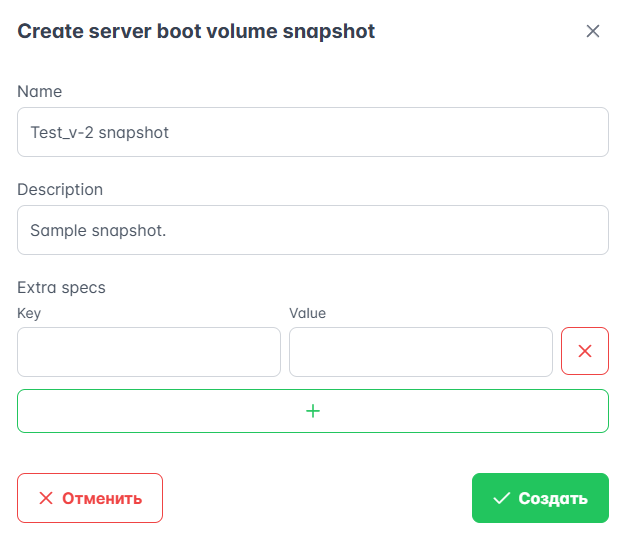

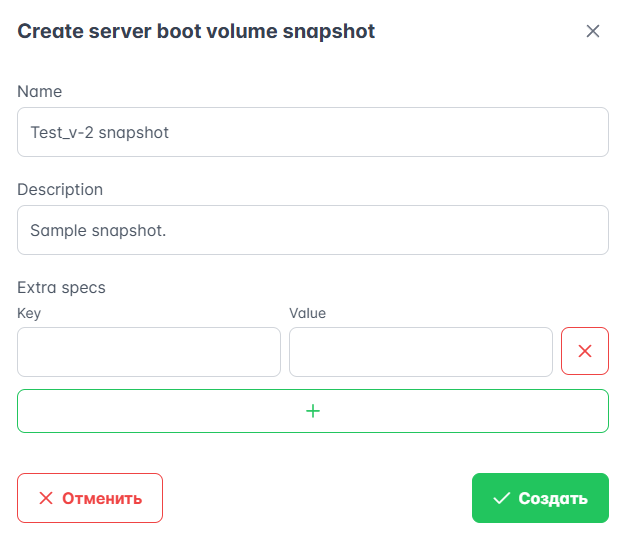

Для создания моментального снимка ВМ:

На вкладке Ресурсы → ВМ выберите виртуальную машину.

Нажмите выпадающий список в столбце “Actions” и выберите “Volume management”, а затем “Create snapshot of boot volume”.

В открывшемся окне укажите имя и название снимка ВМ. Чтобы добавить дополнительные параметры, нажмите

+для “Extra specs”. Нажмите “Создать”.

Рисунок 26 — Создание снимка ВМ

Чтобы откатить ВМ к моментальному снимку:

Клонирование существующих виртуальных машин с кастомизацией

Необходимо выполнить следующие действия:

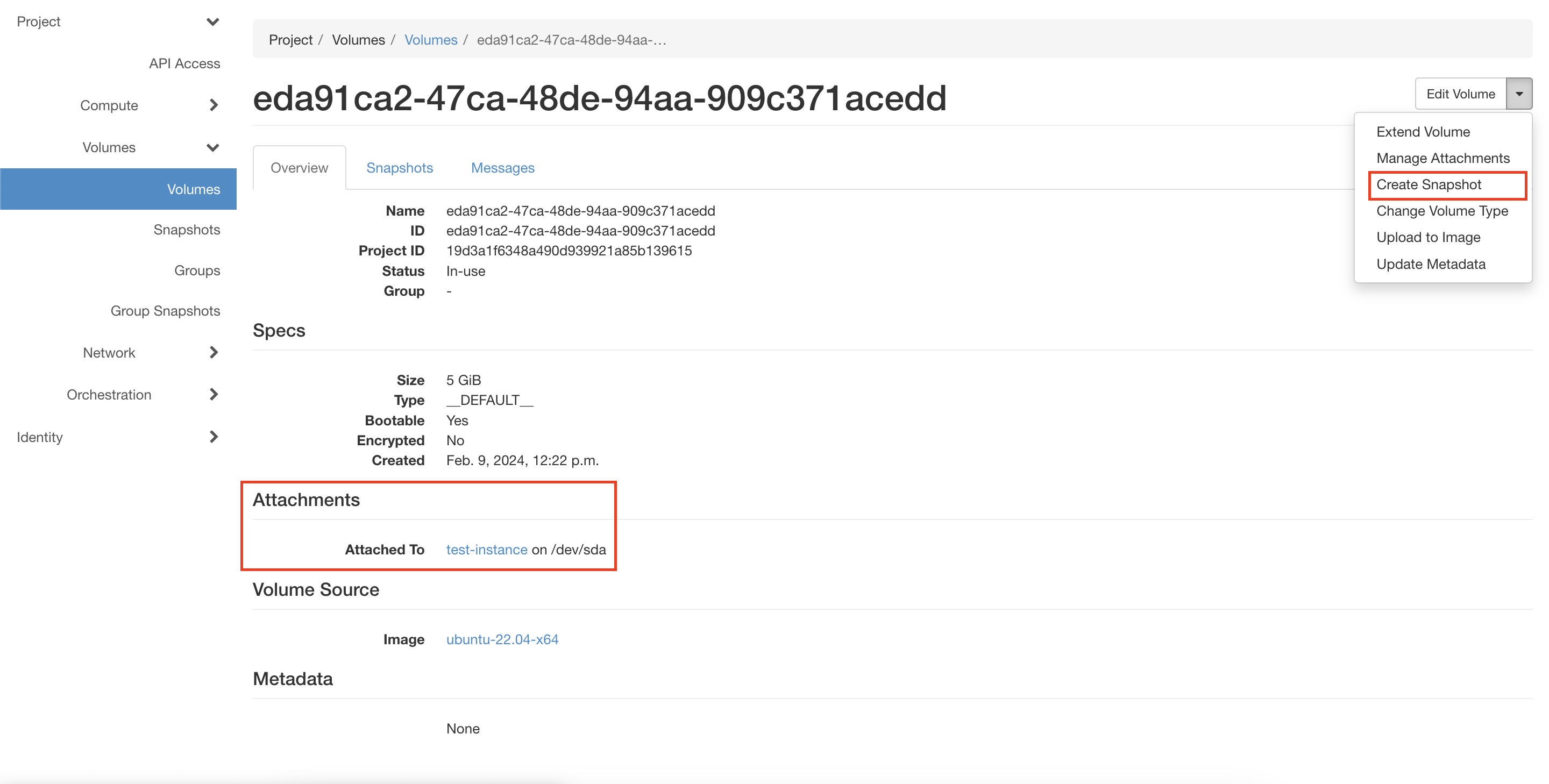

Подключитесь к Порталу самообслуживания.

На странице Project → Volumes → Volumes выберите диск, у которого в колонке “Attached To” указана ВМ, которую нужно скопировать (см. рисунок ниже).

Нажмите выпадающий список в столбце “Actions” и выберите пункт “Create Snapshot”.

Рисунок 28 — Выбор диска

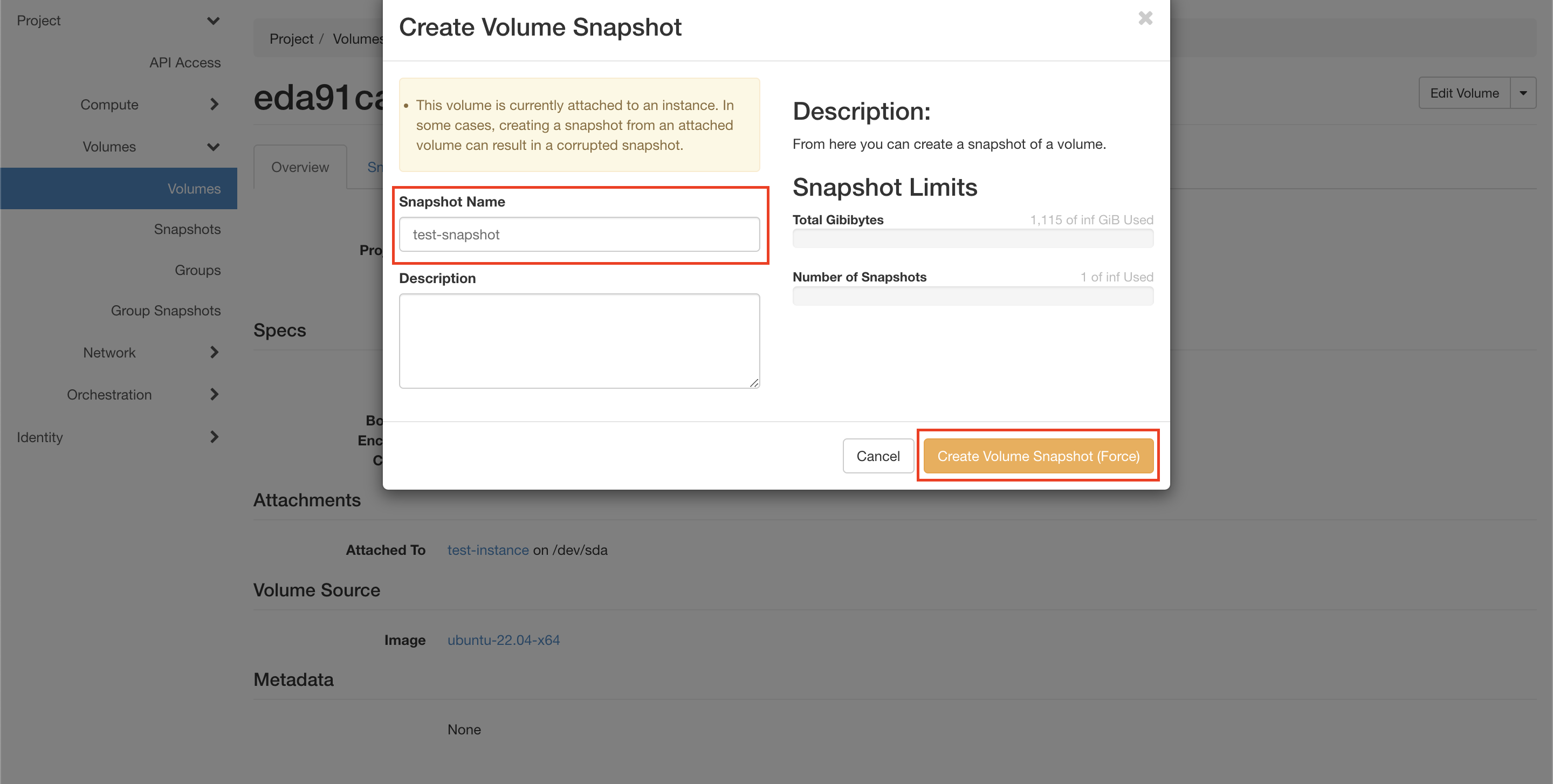

В открывшемся окне введите имя снимка в поле “Snapshot Name” и нажмите кнопку “Create Volume Snapshot (Force)” (см. рисунок ниже).

Рисунок 29 — Создание снимка

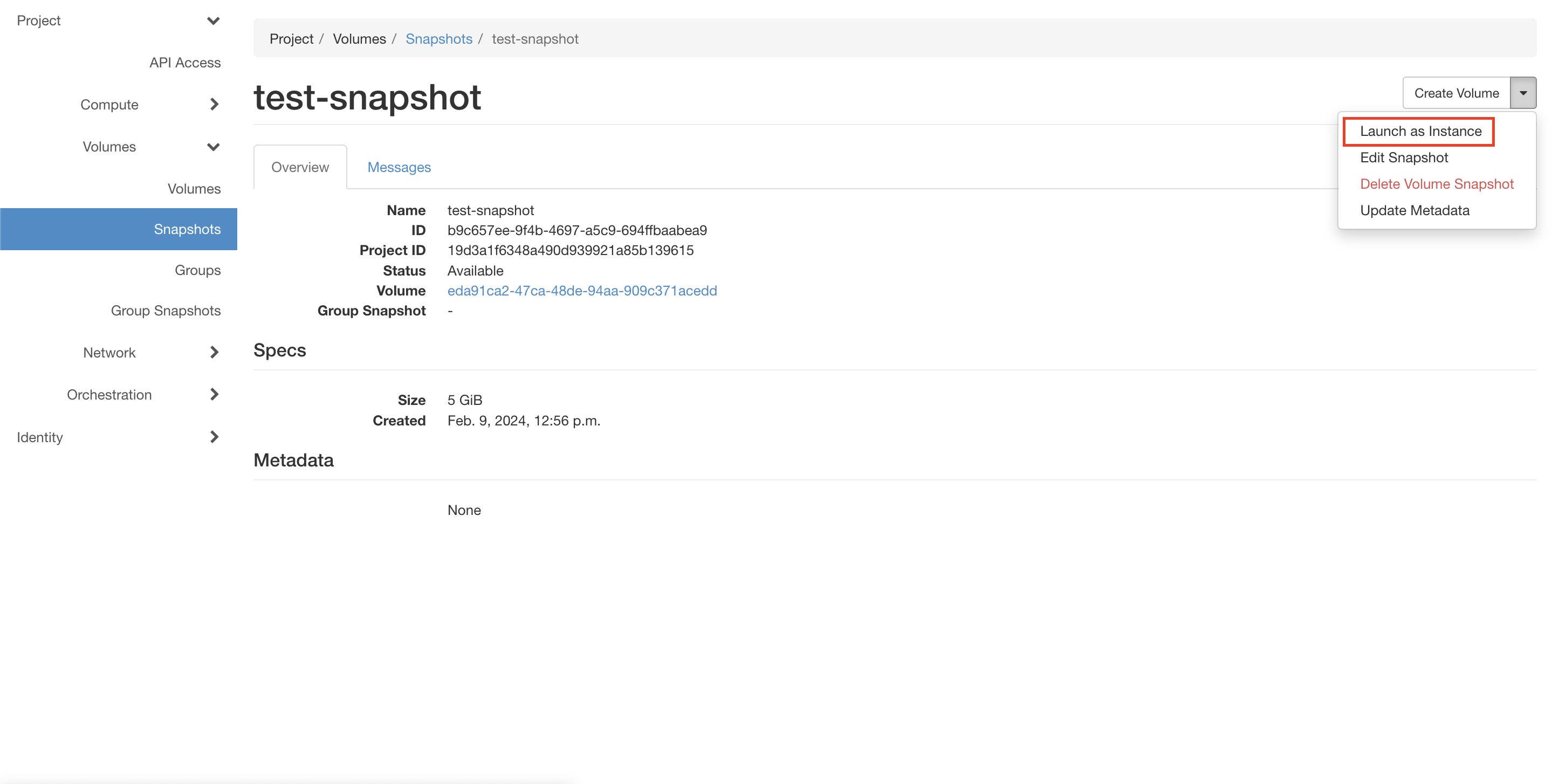

На странице Project → Volumes → Snapshots нажмите выпадающий список в столбце “Actions” в строке тестового снимка.

Выберите пункт “Launch as Instance” (см. рисунок ниже).

Рисунок 30 — Запуск клонированной ВМ

В открывшемся окне заполните следующее:

Вкладка Details:

Instance name: VM_with_CustomizationВкладка Flavor:

Allocated: m1.tinyВкладка Network:

Allocated: privateВкладка Configuration:

Load Customization Script from a file: Загрузить конфигурационный скрипт в виде файлаилиCustomization Script: Ввести конфигурационный скрипт в поле ввода текста

В качестве примера конфигурационного скрипта можно привести следующий скрипт:

#cloud-config

ssh_pwauth: yes

chpasswd:

list: |

ubuntu:123456

root:1234567

expire: False

Нажмите кнопку “Launch as Instance”.

Подключение к VM по SSH должно быть доступно для следующих username/password:

ubuntu/123456root/1234567

Диски

Создание и управление дисками

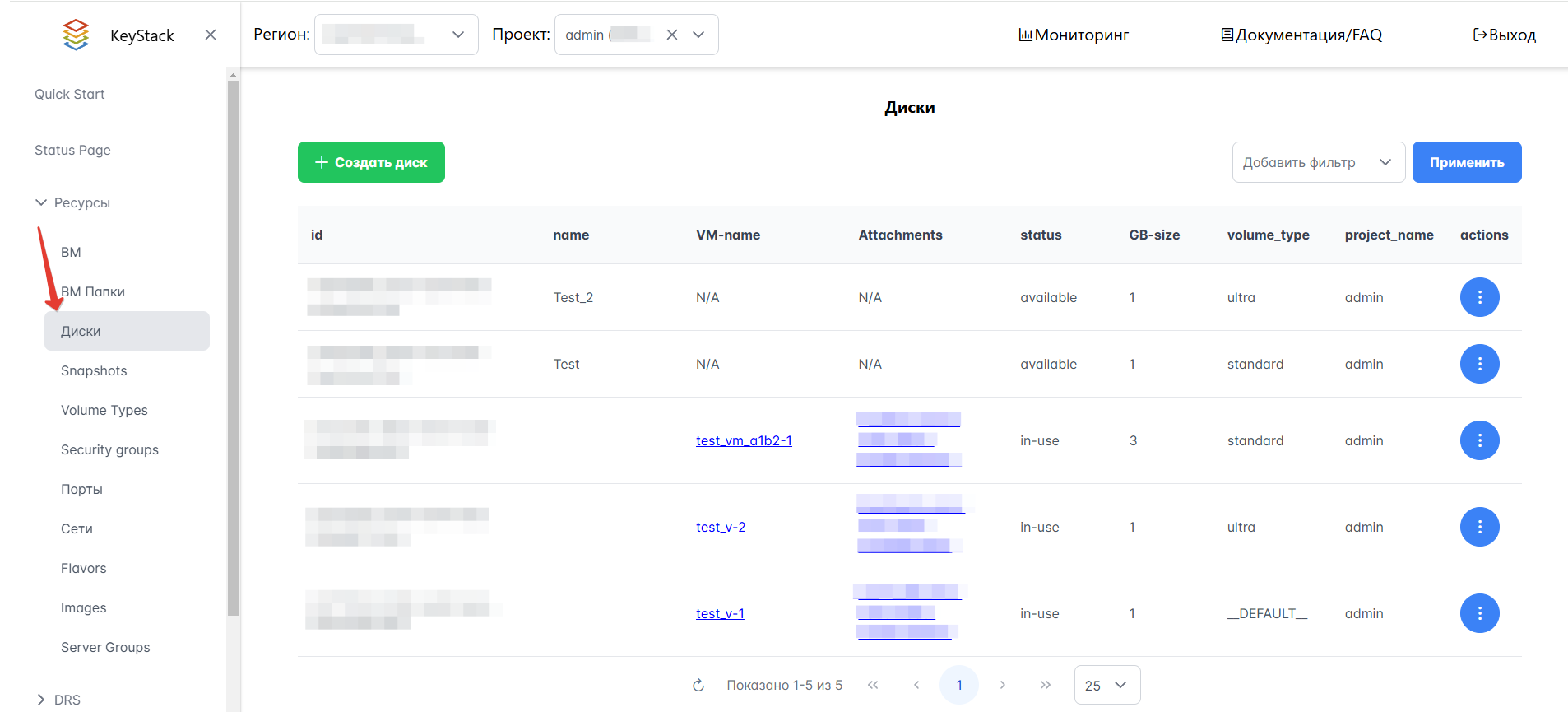

Для просмотра списка дисков на Портале необходимо в левом меню перейти в раздел Ресурсы → Диски. Пример вида раздела представлен на рисунке ниже.

Рисунок 31 — Пример списка дисков

Создание диска

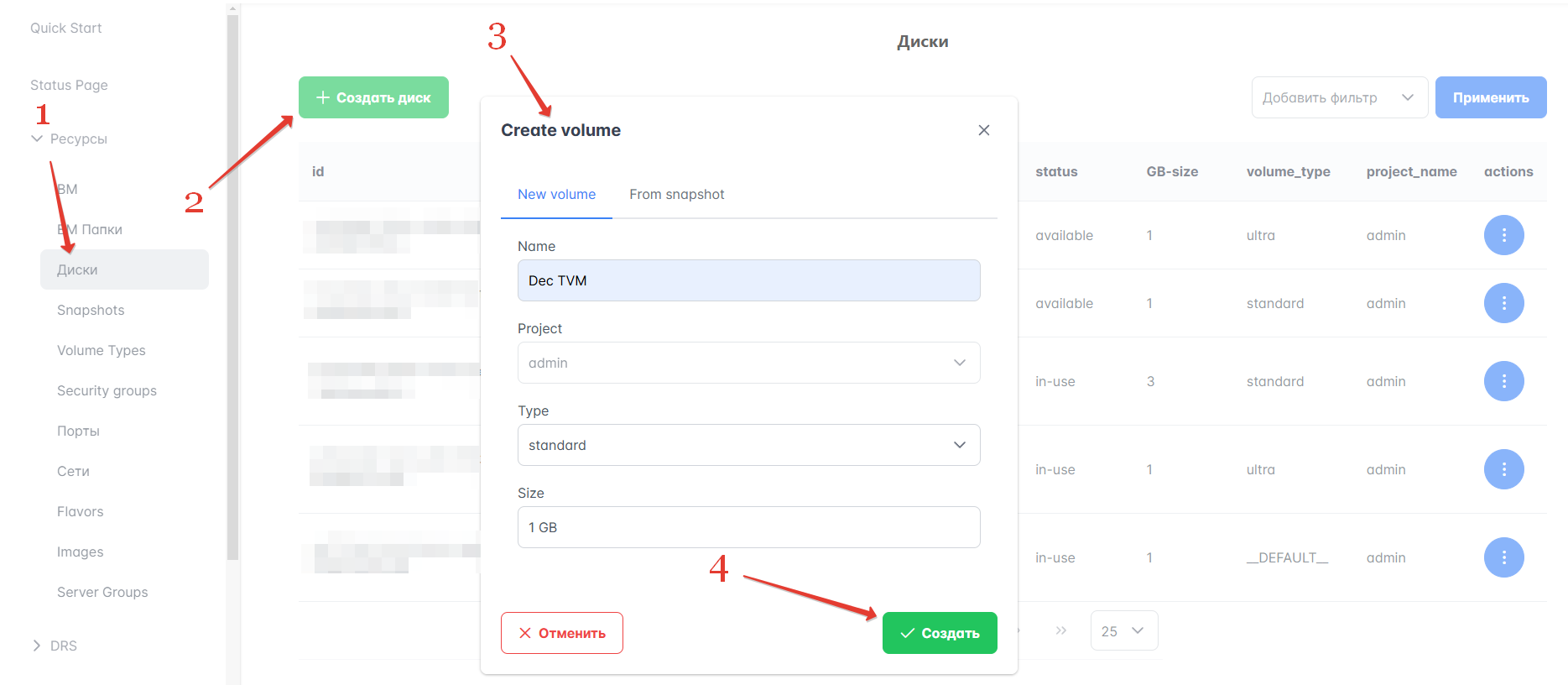

Для создания диска на Портале администратора выполните следующие действия:

В левом меню Портала перейдите в раздел Ресурсы → Диски.

Нажмите кнопку “Создать диск”.

Укажите имя и размер диска. Проект для диска можно изменить в выпадающем списке “Проект” вверху. Пример заполнения см. на рисунке ниже. Чтобы создать диск из снимка, перейдите на вкладку From snapshot и выберите один из доступных снимков в поле Snapshot.

Нажмите кнопку “Создать”.

Рисунок 32 — Создание диска

Изменение параметров диска

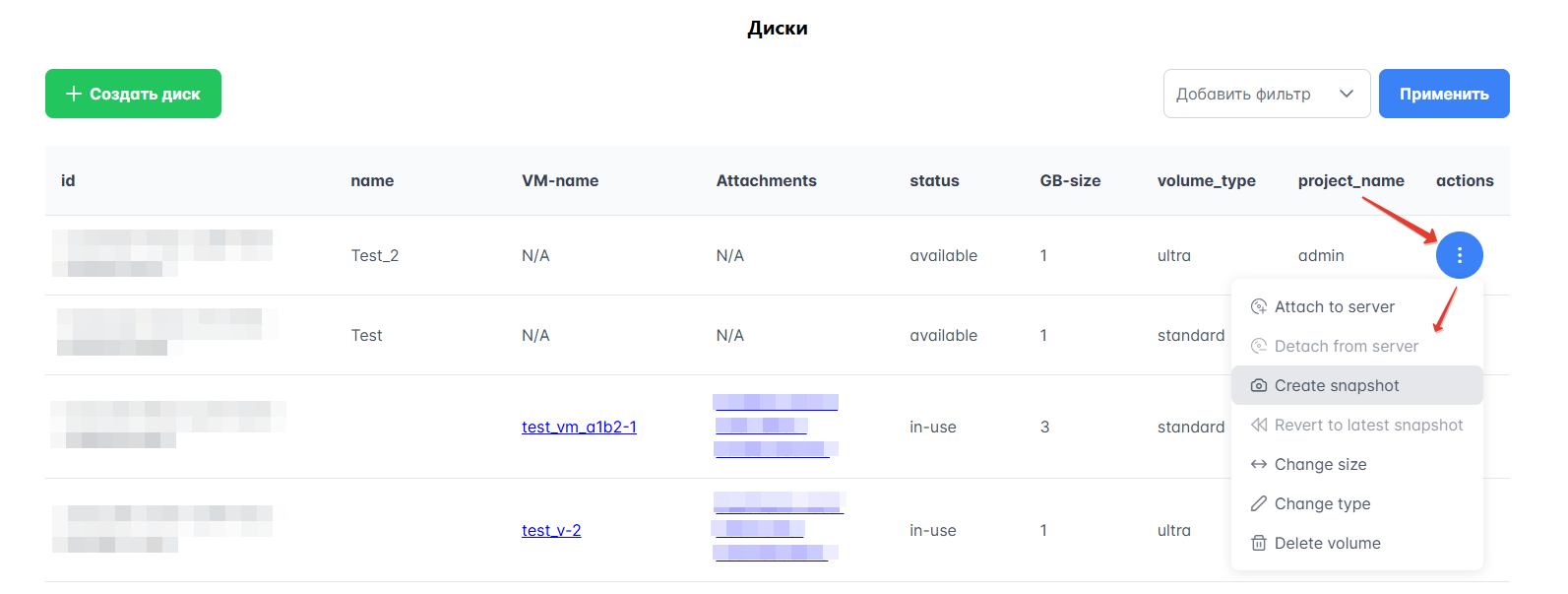

Для внесения изменений в параметры диска выполните следующие действия:

В левом меню Портала перейдите в раздел Ресурсы → Диски.

Нажмите выпадающий список в столбце “Actions” и выберите нужный пункт в зависимости от цели:

Чтобы изменить размер диска, нажмите “Change size”. Новый размер должен быть больше текущего значения. В открывшемся окне укажите размер диска в ГБ и нажмите “Сохранить”.

Чтобы удалить диск, нажмите “Delete volume”. Чтобы удалить вместе с диском все снимки, выберите опцию “Remove any snapshots along with the volume”. Подтвердите действие, нажав “Удалить”.

Чтобы изменить тип томов, к которому принадлежит диск, нажмите типа “Change type”. В открывшемся окне выберите тип в поле “Type”. Если планируете миграцию диска, поменяйте значение с “Never” на “On demand” в “Migrate the volume when it is re-typed”. Нажмите “Применить”.

Если диск не прикреплен к ВМ, нажмите “Attach to server”. В открывшемся окне выберите ВМ в поле “Сервер”. Чтобы при удалении ВМ был удален и этот диск, выберите опцию “Delete on termination”. Нажмите “Прикрепить”.

Рисунок 33 — Изменение параметров диска

Установка параметров QoS для типов дисков

Для работы с QoS на Портале администратора необходимо перейти в раздел Ресурсы → Volume Types в левом меню.

Volume Types

Типы томов необходимы для логического объединения дисков, включенных в определенный том.

По умолчанию Платформа использует тип томов __DEFAULT__. Другие типы томов можно создавать на свое усмотрение. Прежде чем устанавливать параметры QoS, убедитесь, что созданы нужные типы томов. Для просмотра типов томов перейдите в раздел Ресурсы → Volume Types.

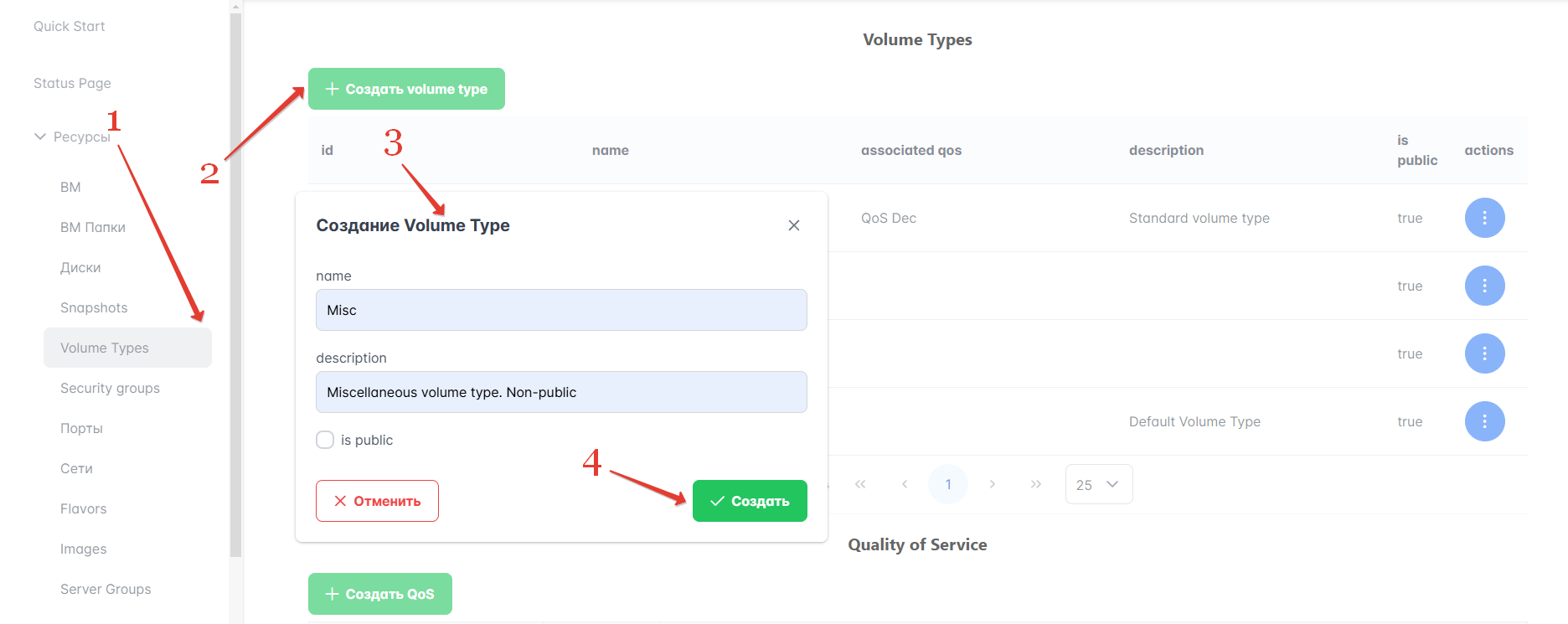

Для создания нового типа томов выполните следующие действия:

В левом меню Портала перейдите в раздел Ресурсы → Volume Types.

Нажмите кнопку “Создать volume type”, расположенную рядом с таблицей Volume Types.

Введите имя и описание типа томов. Чтобы создать приватный тип, доступный только администраторам, снимите флажок для опции “is public”. Эти параметры можно изменить позже для уже созданного типа. Для этого нажмите выпадающий список в столбце “Actions” и выберите “Edit”.

Нажмите кнопку “Создать”.

Рисунок 34 — Создание типа томов

Quality of Service

Quality of Service (QoS) для дисков и томов — это квоты на производительность. QoS регулируют параметры производительности оборудования.

Создавайте QoS, настраивайте их параметры и связывайте их с типами дисков в этом разделе. Таблица Volume Types выше отобразит QoS, связанные с типами томов, в столбце “associated qos”.

Для создания нового QoS выполните следующие действия:

В левом меню Портала перейдите в раздел Ресурсы → Volume Types.

Нажмите кнопку “Создать QoS”, расположенную рядом с таблицей Quality of Service.

Заполните все поля. Эти параметры можно изменить позже, нажав выпадающий список в столбце “Actions” и выбрав “Update”.

Нажмите кнопку “Создать”.

Рисунок 35 — QoS

Для изменения QoS выполните следующие действия:

В разделе Ресурсы → Volume Types перейдите к таблице Quality of Service.

Нажмите выпадающий список в столбце “Actions” и выберите нужный пункт в зависимости от цели:

Чтобы изменить значения параметров QoS, нажмите “Update”. В открывшемся окне укажите новые значения для существующих параметров и нажмите “Применить”.

Если какие-либо параметры QoS еще не указаны, добавьте их с помощью “Add specs”. В открывшемся окне заполните значения для новых параметров и нажмите “Применить”.

Чтобы удалить параметры у QoS, нажмите “Unset”. Выберите один из параметров в открывшемся окне и нажмите “Удалить”. Повторите для всех параметров, которые нужно удалить.

Чтобы удалить QoS, нажмите “Delete”. Подтвердите действие, нажав “Удалить”.

Чтобы привязать QoS к типу томов, выберите “Associate”. В открывшемся окне выберите тип и нажмите “Применить”. Повторите для всех типов, которые нужно привязать к QoS.

Чтобы отвязать QoS от типа томов, выберите “Disassociate”. В открывшемся окне выберите тип и нажмите “Применить”.

Чтобы отвязать QoS от всех типов томов, выберите “Disassociate all”. Подтвердите действие, нажав “Применить”.

Создание и управление снимками дисков

На Портале администратора вы можете создавать моментальные снимки дисков, чтобы сохранить данные виртуальных машин на этих дисках и в случае сбоя восстановить машины из этих снимков. В данный момент технология создания таких снимков дисков поддерживается только для драйверов Huawei Dorado.

Для создания моментального снимка диска:

На вкладке Ресурсы → ВМ выберите виртуальную машину.

Нажмите выпадающий список в столбце “Actions” и выберите “Volume management”, а затем “Create snapshot of boot volume”.

В открывшемся окне укажите имя и название снимка ВМ. Чтобы добавить дополнительные параметры, нажмите

+для “Extra specs”. Нажмите “Создать”.

Рисунок 36 — Создание снимка диска

Чтобы откатить ВМ к моментальному снимку:

Добавление новых вычислительных узлов

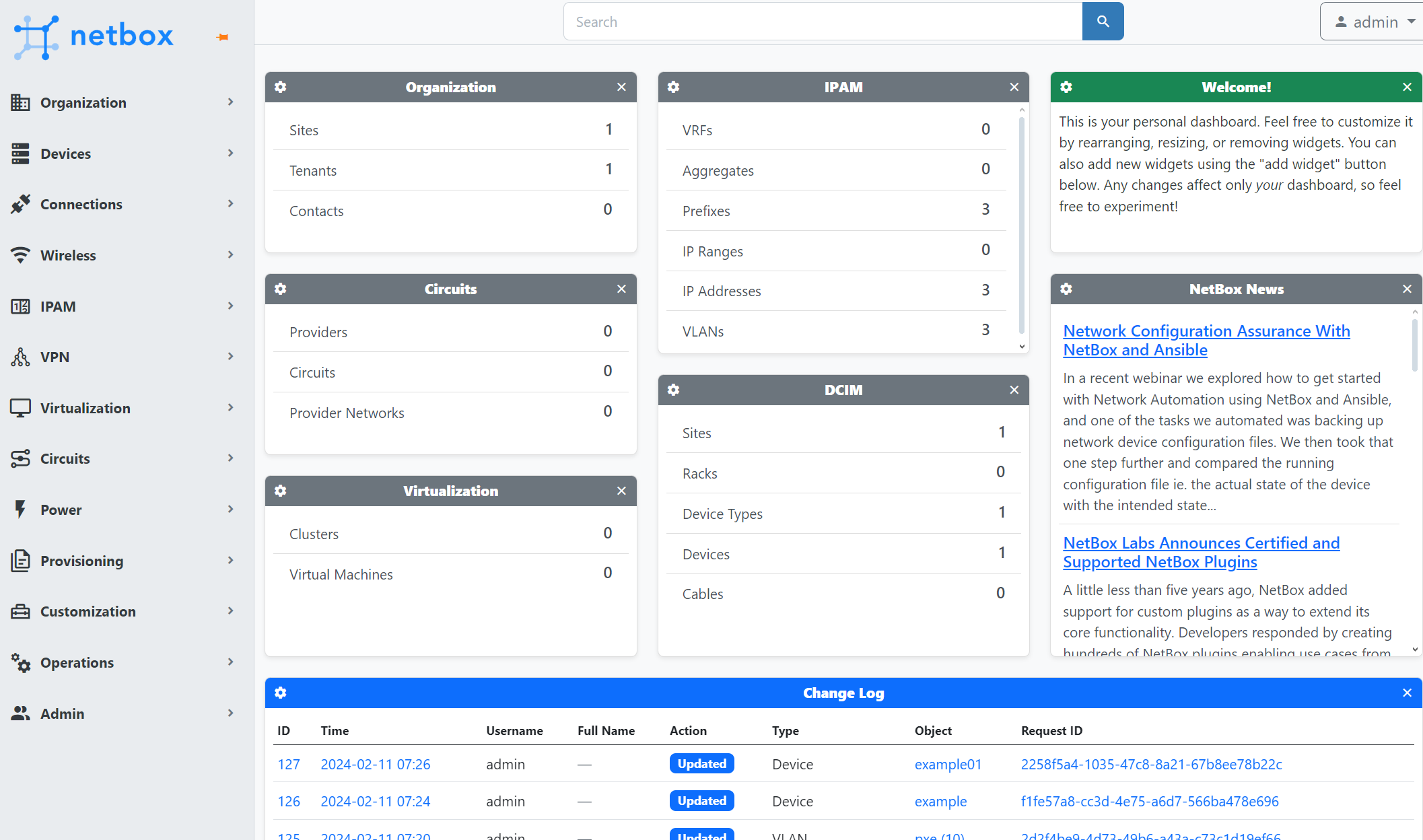

Подготовьте описание серверов для Netbox. Подробнее о Netbox см. в разделе Подсистема хранения данных о физических серверах Netbox.

Для этого нужно добавить в Netbox (пароль можно посмотреть в Vault в разделе Accounts)

https://netbox.<domain_name>/dcim/devices/новое устройство (см. рисунок ниже).

Рисунок 38 — Добавление нового устройства в Netbox

Затем необходимо заполнить поля:

Name — имя сервера;

Device role — Server;

Device type — выбрать соответствующий тип;

Site — выбрать соответствующий сайт, например, ks-region1;

Status — Active;

Tenant — выбрать тенант;

Role — выбрать роль в выпадающем списке (controller, compute или network);

Status — Ready.

После того как устройство будет добавлено, зайдите в него и добавьте сетевые интерфейсы аналогично тому, как изображено на рисунке ниже.

Рисунок 39 — Добавление сетевых интерфейсов

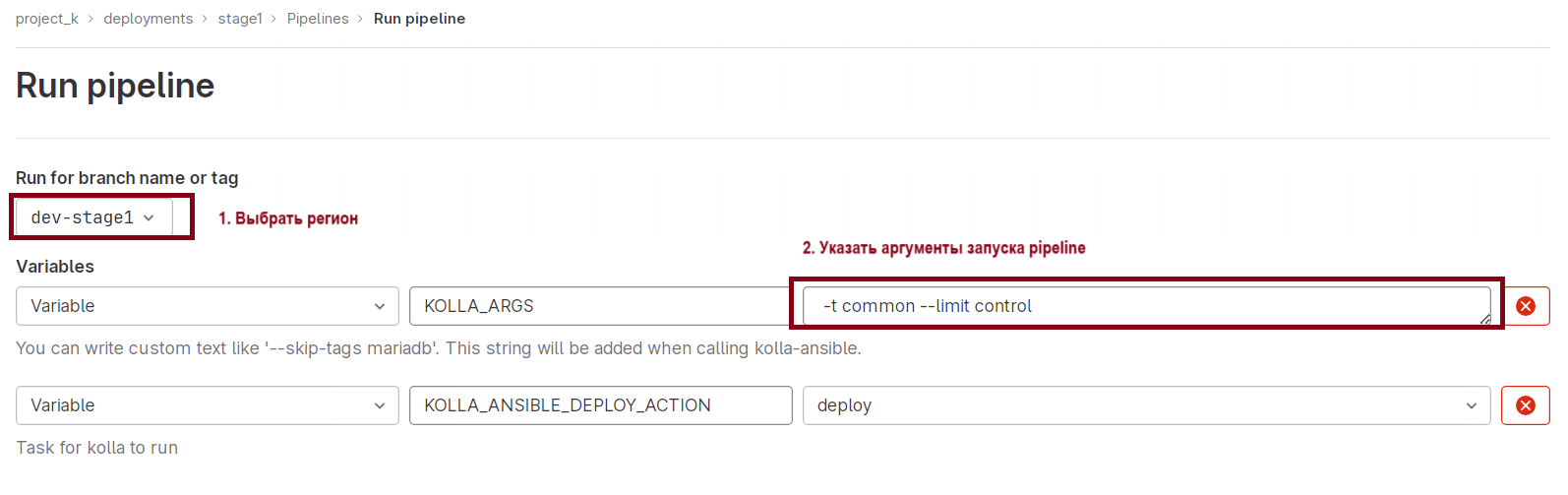

Теперь можно устанавливать операционную систему. Для этого требуется запустить пайплайн

https://<gitlab_url>/project_k/Deployments/baremetal/-/pipelinesи поменять значения для следующих параметров:TARGET_ROLE — compute, controller или network;

TARGET_CLOUD — ks-region1;

IRONIC_IMAGE_URL — во всех сценариях, кроме TARGET_ROLE=network, оставить как есть, в противном случае — указать

http://LCM_IP:8080/ubuntu-20.04-mellanox-keystack.qcow2.

Нужно добавить новый сервер в inventory соответствующего окружения в gitlab.domain_name в группу compute

https://<gitlab_url>/project_k/deployments/stage1/-/blob/dev-stage1/inventory(пример для stage1).Теперь можно запускать kolla-ansible bootstap:

https://<gitlab_url>/project_k/Deployments/<ENV>/-/pipelines

https://<gitlab_url>/project_k/deployments/stage1/-/pipelinesПроверьте, что гипервизор функционирует, как ожидается — создаются виртуальные машины, работает миграция, работает сетевая связность — доступ по SSH до тестовых виртуальных машин:

Создайте виртуальную машину на требуемом гипервизоре через CLI:

openstack server create --image <image_id> --flavor <flavor_id> --availability-zone nova:<hypervisor_host_name> --nic net-id=<network_id> Test-VMПроверьте, что она создалась и перешла в статус ACTIVE, через

openstack server show <server_id>.Добавьте к ней FIP и проверить SSH-доступ (должно быть соответствующее разрешающее правило).

Убедитесь, что виртуальную машину можно мигрировать (миграция ВМ возможна такая: Mirantis → Keystack или Keystack → Keystack). Сделать это можно через CLI:

openstack server migrate --os-compute-api-version 2.87 --live-migration <instance_id> --host <new_host_name>

Удаление вычислительного узла из кластера

Удалите описание сервера из Netbox: https://netbox.<domain_name>/dcim/devices/

Удалите сервер из inventory из группы [compute]: https://<gitlab_url>/project_k/deployments/stage1/-/blob/dev-stage1/inventory (пример для stage1).

Далее следует удалить связанные сущности в Openstack (предполагается, что виртуальных машин на сервере нет):

HOST_FOR_REMOVAL=<computeN>

openstack --os-compute-api-version 2.87 compute service list --host $HOST_FOR_REMOVAL --service nova-compute -f value -c ID | xargs openstack --os-compute-api-version 2.87 compute service delete

openstack network agent list --host $HOST_FOR_REMOVAL -f value -c ID | while read agent_id; do openstack network agent delete $agent_id; done

openstack resource provider list --name $HOST_FOR_REMOVAL -f value -c uuid | xargs openstack resource provider show --allocations -f json |jq .allocations | jq 'keys[]' | xargs -n1 openstack resource provider allocation delete

openstack resource provider list --name $HOST_FOR_REMOVAL -f value -c uuid | xargs openstack resource provider delete

Настройки региона

Файлы конфигурации (Конфиги)

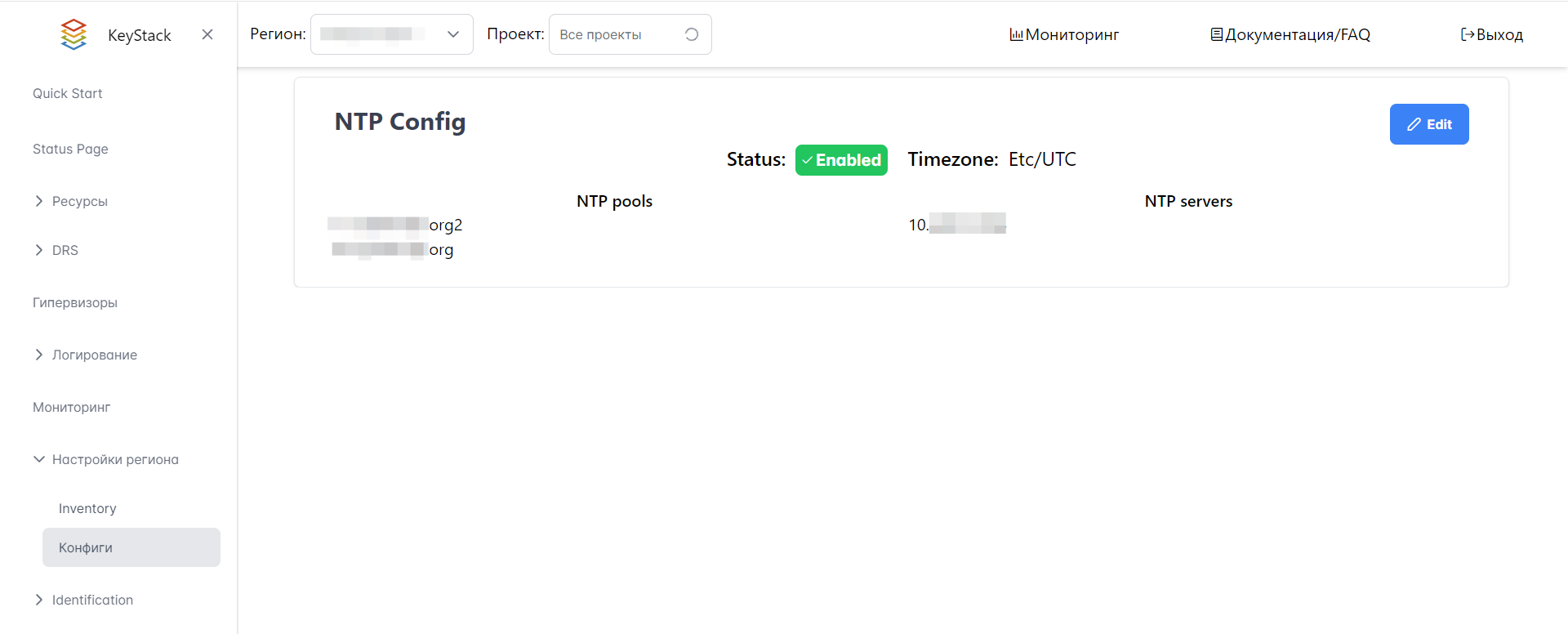

NTP Config

На Портале администратора можно просматривать и менять некоторые настройки серверов NTP (Network Time Protocol).

Рисунок 40 — NTP Config

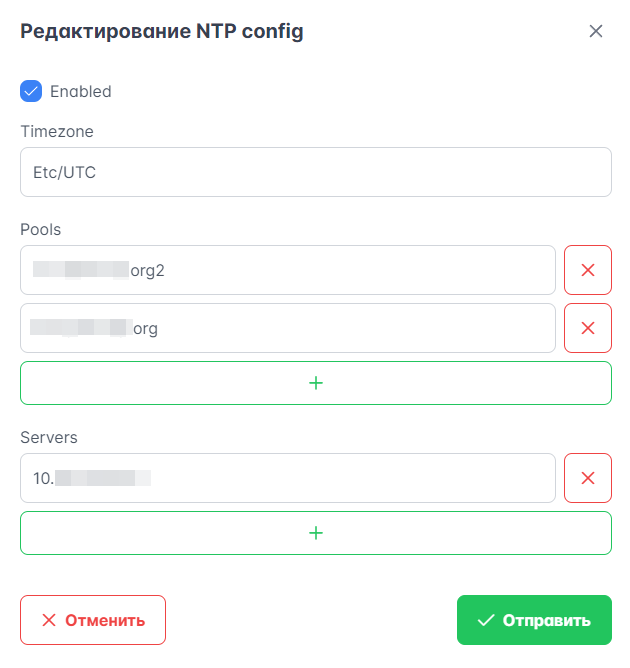

Для внесения изменений в файл конфигурации NTP нажмите кнопку “Edit”. Можно добавлять, изменять и удалять следующие настройки:

часовой пояс;

пулы;

серверы.

Флажок “Enabled” отображает статус файла конфигурации.

Рисунок 41 — Изменение настроек NTP Config

Изменения файла на Портале администратора передаются в GitLab и там сохраняются. Для того, чтобы применить настройки, их нужно запустить с помощью пайплайна, применив bootstrap-servers и host configs.

Пример:

https:///project_k/deployments/<REGION_NAME>/-/pipelines

Run pipeline → Run pipeline → bootstrap-servers → host configs.

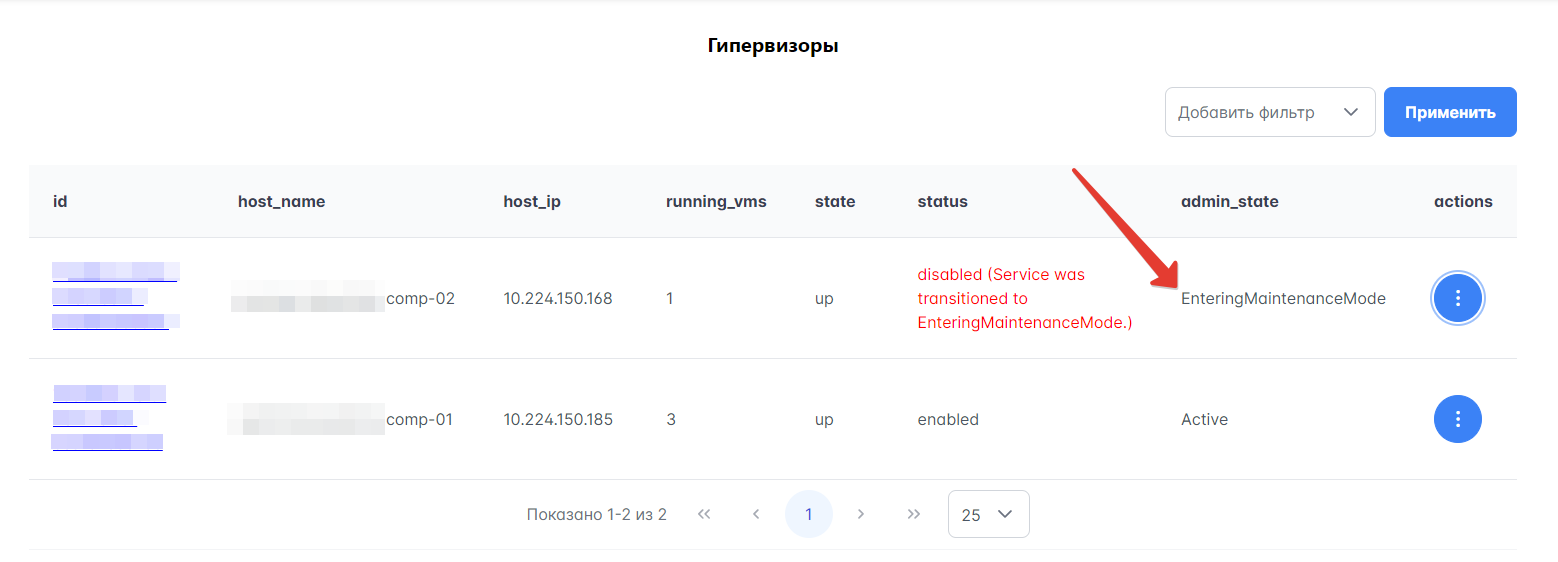

Режим обслуживания вычислительных узлов (гипервизоров)

Для обслуживания вычислительного узла (гипервизора) предусмотрен механизм временного отключения узла из кластера.

На Портале администратора можно отследить процесс перехода гипервизора в режим обслуживания (maintenance mode). Для этого нужно перейти в раздел Гипервизоры → Гипервизоры и посмотреть значение в столбце “admin_state”. При выборе действия “Enable maintenance mode” гипервизор переходит в режим обслуживания, а статус и значение “admin_state” меняется на EnteringMaintenanceMode.

Перевод вычислительного узла в режим обслуживания

Для перевода узла в режим обслуживания необходимо выполнить следующие действия:

На Портале администратора перейдите в раздел Гипервизоры → Гипервизоры.

В выпадающем списке “Actions” для этого узла выберите действие “Enable maintenance mode”. ВМ при таком состоянии продолжают работать на узле, а новые ВМ не могут быть запущены.

На рисунке ниже показан процесс перевода гипервизора в maintenance mode.

Дождитесь, когда статус гипервизора сменится с

EnteringMaintenanceModeна новый. Если по какой-то причине гипервизор не перешел в maintenance mode, это будет отображено в статусе так:disabled (Service was transitioned to Error.). В столбце “admin_state” будет описана причина — например,Error (Live migration of server N failed). В таком случае можно либо повторно попробовать перевести гипервизор в режим обслуживания, нажав “Enable maintenance mode” — либо вернуть его в статус “enabled”, выбрав “Enable Service”.

В процессе перехода в режим обслуживания все ВМ с данного узла мигрируют на другие узлы, включенные без прерывания их работы.

Если гипервизор переведен в режим обслуживания, эвакуация ВМ происходит параллельно. Примерно 3-5 машин могут быть эвакуированы за раз. При этом в качестве причины отключения узла (disable_reason) выставляется maintenance mode: disable_service_by_uuid(token, service_id, reason='maintenance mode', region=region).

После перехода в режим обслуживания вычислительный узел можно отключать от сети, выключать по питанию и производить работы по ремонту или модернизации.

Эвакуация агрегатов

Агрегат (host aggregate) — это группа вычислительных узлов, объединенных логически на основе таких характеристик, как аппаратные средства или показатели производительности. Один вычислительный узел можно назначить как одному, так и нескольким агрегатам.

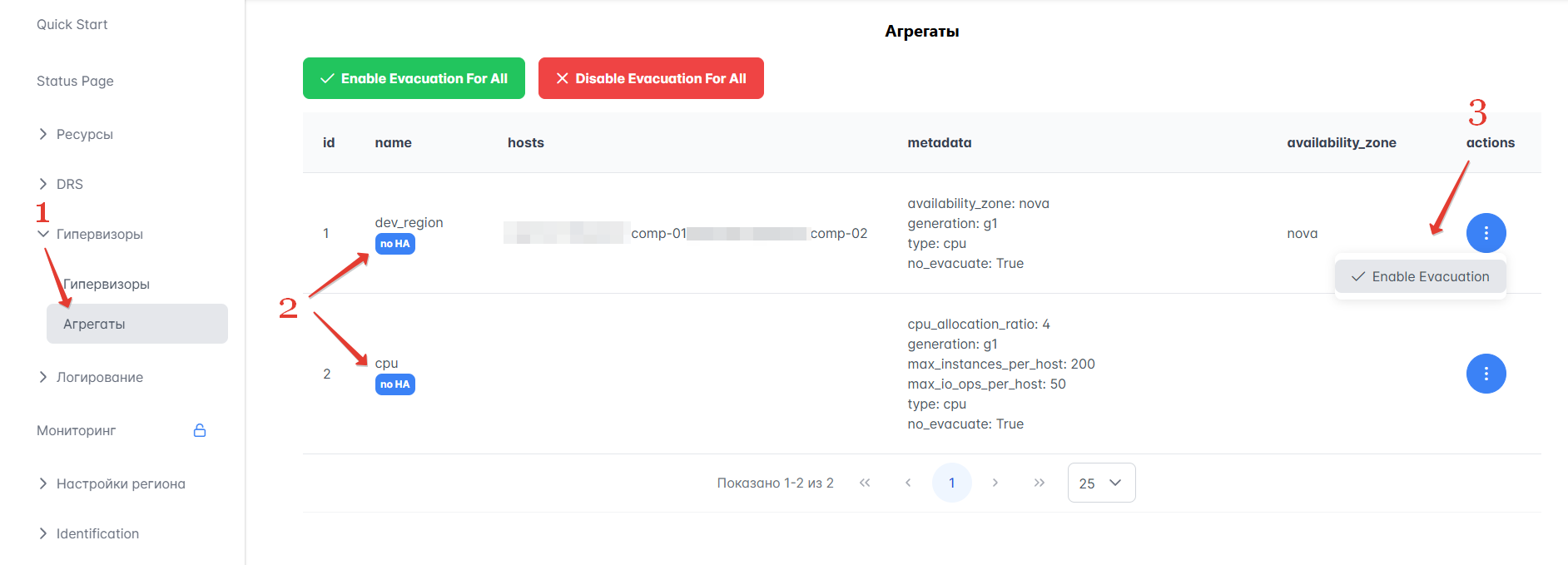

На Портале администратора список агрегатов доступен в разделе Гипервизоры → Агрегаты. Вы можете переводить агрегаты в режим высокой доступности (high availability, или HA) и тем самым эвакуировать их. Если для агрегата не включен режим HA, возле его название есть лейбл no HA.

Для перевода агрегата в режим HA выполните следующие действия:

Перейдите в раздел Гипервизоры → Агрегаты.

Посмотрите, какие агрегаты отмечены лейблом

no HA. Эти агрегаты вы сможете эвакуировать.Переведите один или несколько агрегатов в режим HA:

Чтобы эвакуировать конкретный агрегат, выберите “Enable evacuation” в выпадающем списке “Actions” для этого агрегата. На рисунке ниже приведен пример.

Чтобы эвакуировать все агрегаты, нажмите кнопку “Enable Evacuation For All” вверху.

Рисунок 43 — Эвакуация агрегатов

Подтвердите действие, нажав “Включить” в открывшемся окне.

Для вывода агрегатов из режима HA повторите действия выше с тем отличием, что в выпадающем списке “Actions” нужно будет выбрать “Disable evacuation”, а при выборе всех агрегатов — нажать кнопку “Disable Evacuation For All”.

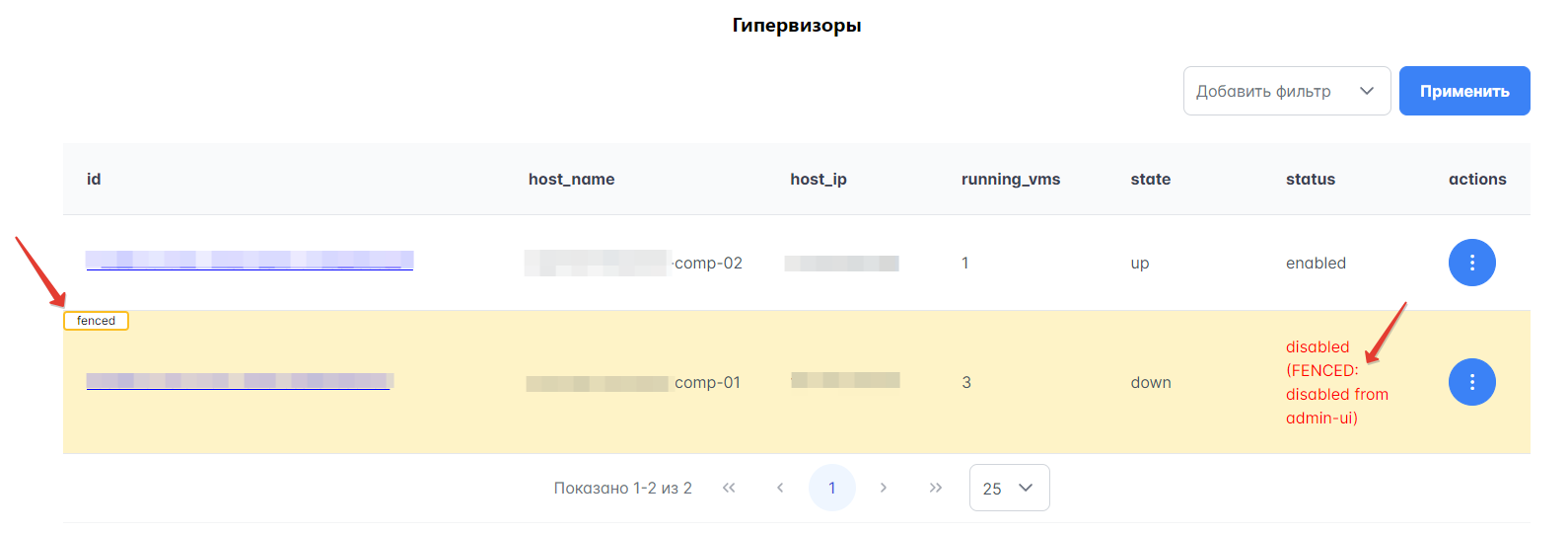

Фенсинг узлов (fencing)

Фенсинг узлов (гипервизоров) проводит HA. Фенсинг — механизм исключения неисправного узла из кластера, чтобы этот узел больше не работал с ВМ. После проведения фенсинга узлы могут оказаться в статусе “fenced”, что будет отражено на Портале администратора. Такие узлы опознаются по префиксу FENCED: `` в ``disabled_reason.

Чтобы вывести узлы из этого состояния, выполните следующие действия:

В левом меню Портала перейдите в раздел Гипервизоры → Гипервизоры.

Найдите в таблице узел, который выделен желтым цветом и обозначен лейблом “fenced”.

В выпадающем списке “Actions” для этого узла выберите действие “Disable Fence Mode”.

Рисунок 44 — Узел в статусе “fenced”

Подсистема передачи данных

В Платформе используется топология сети с плоскими VLAN, часть параметров GRE / VXLAN не поддерживается.

Просмотр сетей

openstack network listopenstack subnet pool listВы также можете просматривать сети и их подсети на Портале администратора. Для этого в левом меню Портала перейдите в раздел Ресурсы → Сети.

Просмотр настроек виртуальной сети

Для просмотра настроек виртуальной сети могут использоваться интерфейсы Портала администратора, Horizon или OpenStack CLI.

Для просмотра настроек виртуальной сети в Horizon необходимо выполнить следующие действия:

Перейдите в раздел Проект → Сети. Будет отображен список сетей, к которым имеет доступ данный проект.

Рисунок 45 — Список сетей проекта

Перейдите в карточку виртуальной сети щелчком мыши по ее названию. Вид раздела настроек виртуальной сети представлен на рисунке ниже.

Рисунок 46 — Отображение настроек виртуальной сети

Для просмотра виртуальной сети с помощью клиента Openstack CLI необходимо подключиться по протоколу SSHv2 к управляющему узлу control1 и выполнить следующую команду в контейнере kolla_toolbox:

openstack network show <имя_виртуальной_сети>

Для просмотра свойств подсетей (subnet) с помощью клиента Openstack CLI необходимо выполнить команду в контейнере kolla_toolbox:

openstack subnet show <имя_subnet>

Создание виртуальной сети и соответствующей ей подсети

Для создания сети используется команда openstack network create. Полный синтаксис команды:

openstack network create

[--share | --no-share]

[--enable | --disable]

[--project <project>]

[--description <description>]

[--mtu <mtu>]

[--project-domain <project-domain>]

[--availability-zone-hint <availability-zone>]

[--enable-port-security | --disable-port-security]

[--external | --internal]

[--default | --no-default]

[--qos-policy <qos-policy>]

[--transparent-vlan | --no-transparent-vlan]

[--provider-network-type <provider-network-type>]

[--provider-physical-network <provider-physical-network>]

[--provider-segment <provider-segment>]

[--dns-domain <dns-domain>]

[--tag <tag> | --no-tag]

--subnet <subnet>

<name>

где:

–share — сеть доступна другим проектам;

–no-share — сеть недоступна другим проектам;

–enable — включить сеть;

–disable — отключить сеть;

–project — проект владельца сети (наименование или ID);

–description — описание сети;

–mtu — установить указанный MTU;

–project-domain <project-domain> — домен проекта (наименование или ID). Опция используется в случае конфликтов между названиями проектов;

–availability-zone-hint <availability-zone> — зона доступности, в которой необхоодимо создать сеть;

–enable-port-security — включить защиту порта по умолчанию для портов, созданных в этой сети (опция по умолчанию);

–disable-port-security — отключить защиту порта по умолчанию для портов, созданных в этой сети;

–external — признак внешней сети;

–internal — признак внутренней сети;

–default — признак использования сети в качестве внешней по умолчанию;

–no-default — не использовать сеть в качестве внешней по умолчанию;

–qos-policy <qos-policy> — политика QoS для подключения к этой сети (имя или идентификатор);

–transparent-vlan — сделать сеть VLAN прозрачной;

–no-transparent-vlan — не делать сеть VLAN прозрачной;

–provider-network-type <provider-network-type> — физический механизм реализации виртуальной сети. Например: flat, geneve, gre, local, vlan, vxlan;

–provider-physical-network <provider-physical-network> — имя физической сети, в которой реализована виртуальная сеть;

–provider-segment <provider-segment> — VLAN ID для сетей VLAN или Tunnel ID для сетей GENEVE / GRE / VXLAN;

–dns-domain <dns-domain> — установить DNS-домен для этой сети;

–tag <tag> — добавить тег к сети. Может использоваться несколько раз для указания нескольких тегов;

–no-tag — нет тегов, связанных с сетью;

–subnet <subnet> — подсеть IPv4 для фиксированных IP-адресов (в нотации CIDR);

<name> — наименование создаваемой сети.

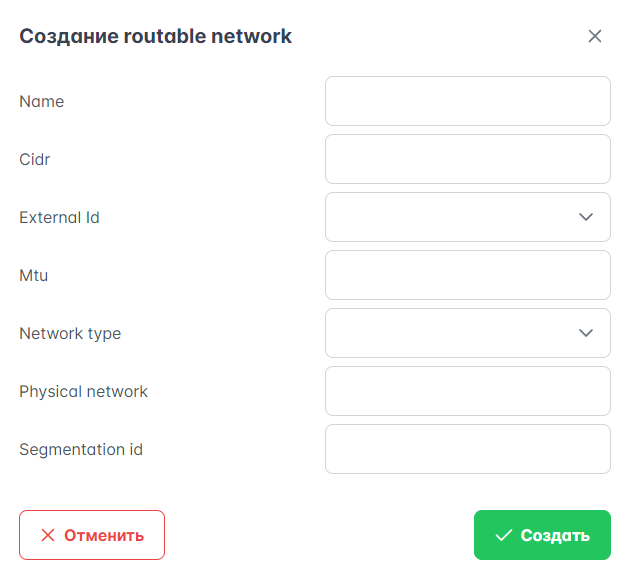

Для создания сети на Портале администратора:

В левом меню Портала перейдите в раздел Ресурсы → Сети и нажмите кнопку “Создать сеть”.

В открывшемся окне заполните поля. Обязательно нужно указать имя сети, CIDR и внешний ID. Поддерживаются разные типы сетей: FLAT, VLAN, VXLAN и GRE.

Когда все поля будут заполнены, нажмите кнопку “Создать”.

Рисунок 47 — Создание сети на Портале администратора

Создание подсети

Для создания подсети используется команда openstack subnet crate. Полный синтаксис команды:

openstack subnet create

[--project <project>]

[--project-domain <project-domain>]

[--subnet-pool <subnet-pool>]

[--prefix-length <prefix-length>]

[--subnet-range <subnet-range>]

[--dhcp | --no-dhcp]

[--dns-publish-fixed-ip | --no-dns-publish-fixed-ip]

[--gateway <gateway>]

[--ip-version {4,6}]

[--network-segment <network-segment>]

--network <network>

[--description <description>]

[--allocation-pool start=<ip-address>,end=<ip-address>]

[--dns-nameserver <dns-nameserver>]

[--host-route destination=<subnet>,gateway=<ip-address>]

[--service-type <service-type>]

[--tag <tag> | --no-tag]

<name>

где:

–project <project> — проект владельца (наименование или ID);

–project-domain <project-domain> — домен проекта (наименование или ID). Опция используется в случае конфликтов между названиями проектов;

–subnet-pool <subnet-pool> — пул адресов, из которого эта подсеть получит CIDR (наименование или идентификатор);

–prefix-length <prefix-length> — длина префикса для выделения подсети из пула подсетей;

–subnet-range <subnet-range> — диапазон подсети в нотации CIDR (требуется, если –subnet-pool не указан, в противном случае — необязательный);

–dhcp — разрешить DHCP (по умолчанию);

–no-dhcp — запретить DHCP;

–dns-publish-fixed-ip — включить публикацию фиксированных IP-адресов в DNS;

–no-dns-publish-fixed-ip — отключить публикацию фиксированных IP-адресов в DNS;

–gateway <gateway> — шлюз подсети. Доступны три варианта:

<ip-address> — конкретный IP-адрес для использования в качестве шлюза — например, –gateway 192.168.9.1,;

‘auto’ — адрес шлюза должен автоматически выбираться из самой подсети — например, –gateway auto;

‘none’ — подсеть не использует шлюз — например, –gateway none.

–ip-version <IP_VERSION> — версия IP (значение по умолчанию — 4). Версия 6 не доступна в Платформе;

–network-segment <network-segment> — сегмент сети, который нужно связать с этой подсетью (наименование или ID);

–network <network> — сеть, к которой принадлежит эта подсеть (наименование или ID);

–description <description> — описание подсети;